- Will ich oder will ich nicht?

- 0 Graphen in Wort und Bild

- 1 Graphen und Mathematik

- 1.1 Adjazenz, Inzidenz, Laplace und Grad

- Ausflug in die Lineare Algebra

- Fortsetzung 1.1

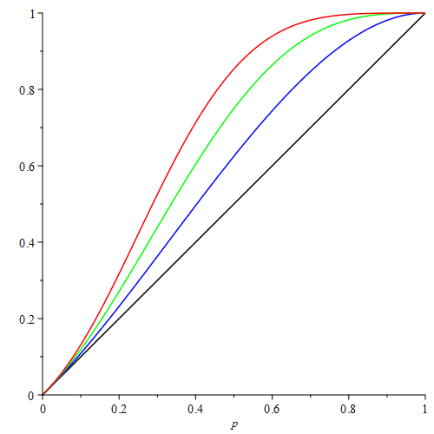

- 1.2 Spektral Layout

- 1.3 Der Zufallswanderer

- 1.4 Gleichstromkreise als Graphen

- 2 Von v nach w, Wege durch Graphen

- 2.1 Der Nikolaus in Königsberg

- 2.2 Kurz und knapp

- 3 Man sieht den Wald vor Bäumen nicht

- 3.1 Zu bunt?

- 3.2 Unter Spannung

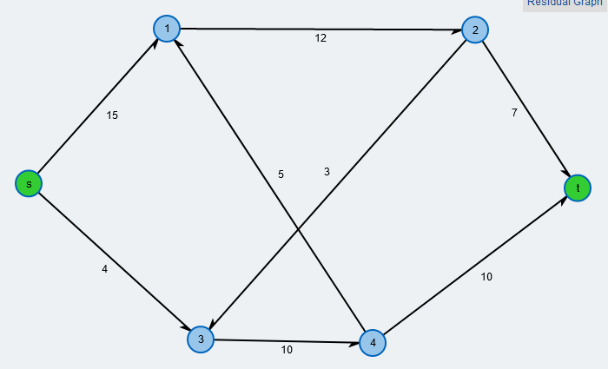

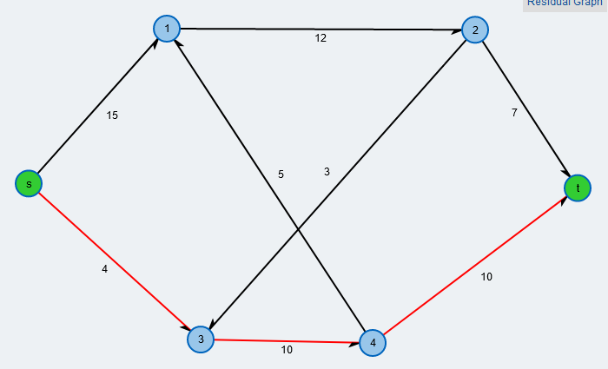

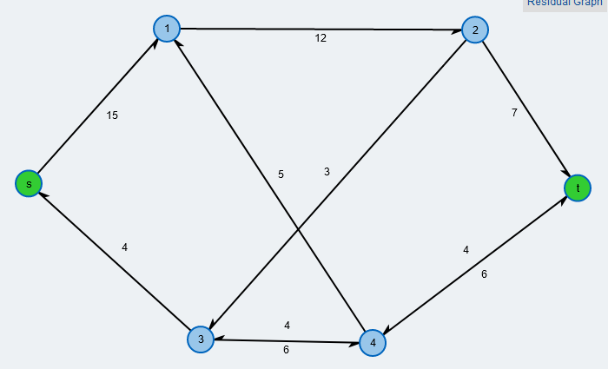

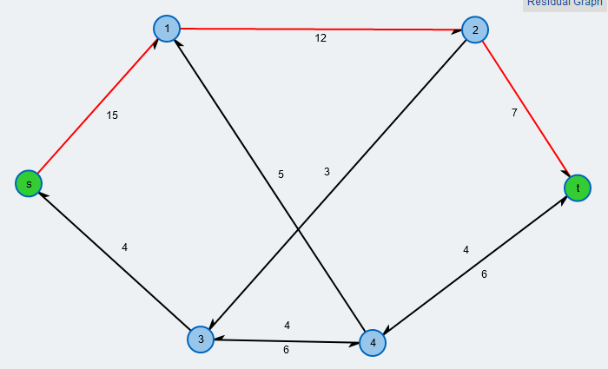

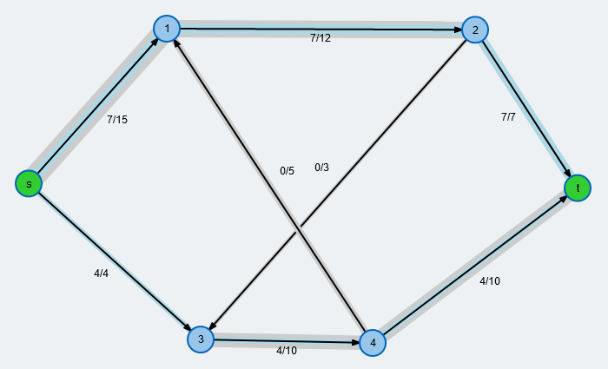

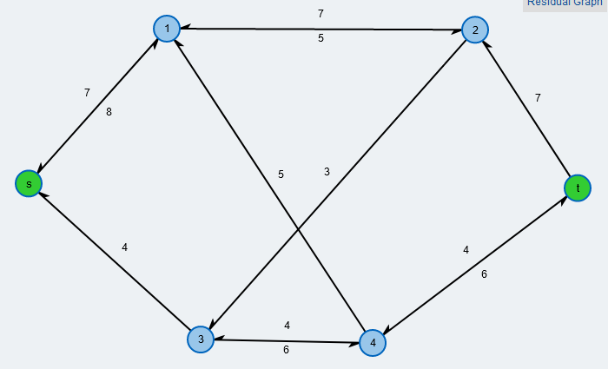

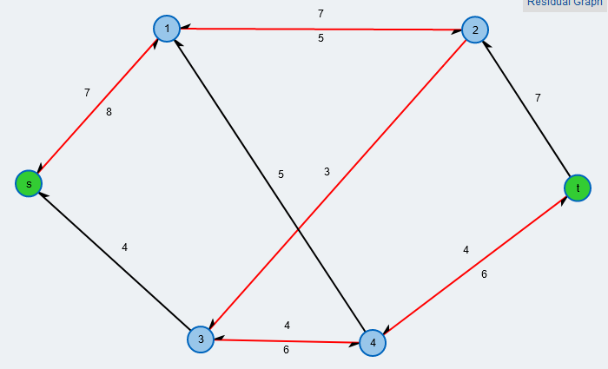

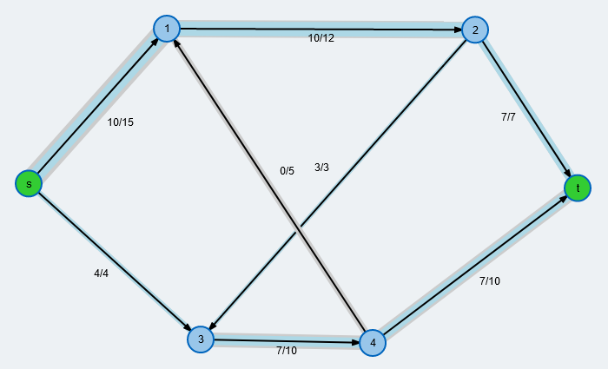

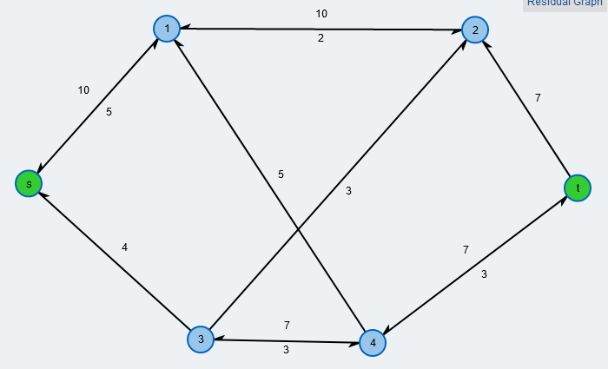

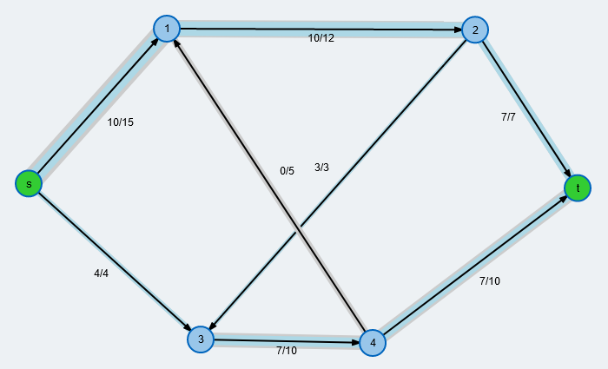

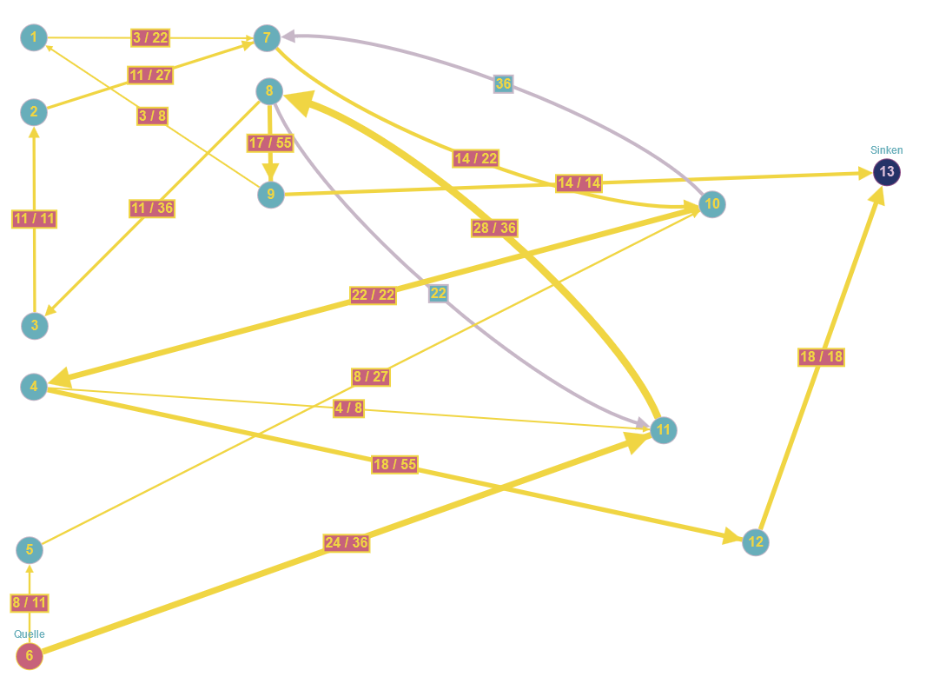

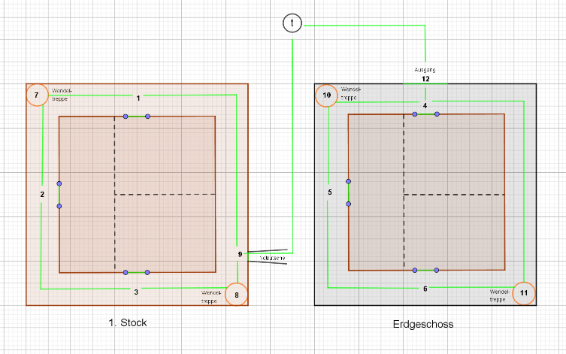

- 4 Panta rei - Alles fließt

- 4.1 Nichts wie raus!

- 4.2 Wer mit wem?

- 5 Und sonst?

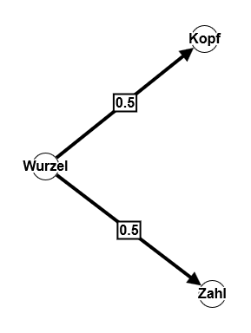

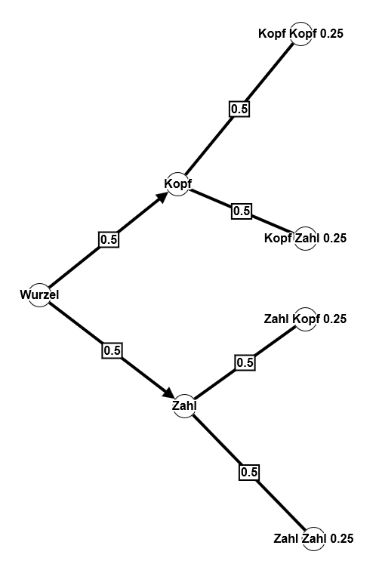

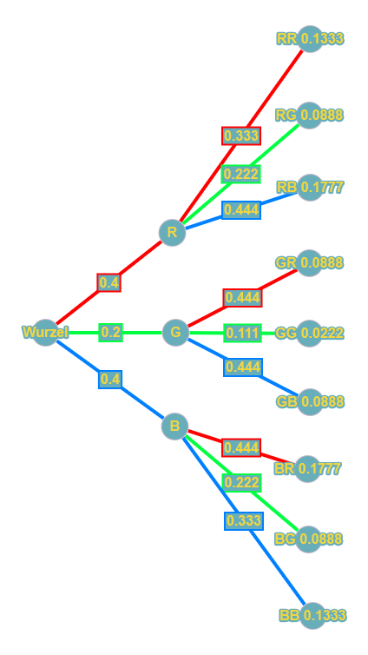

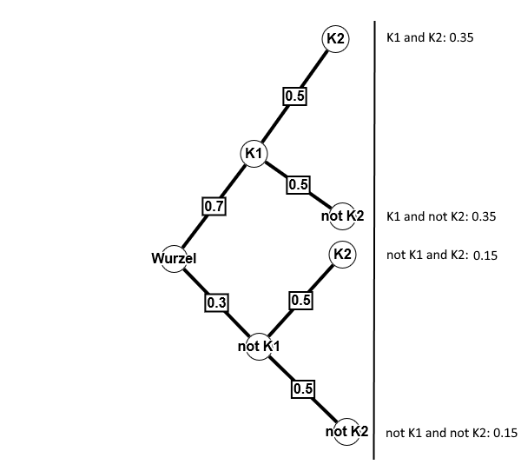

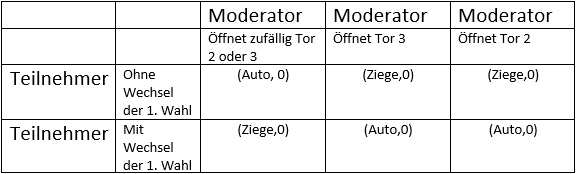

- 5.1 Wahr - scheinlich

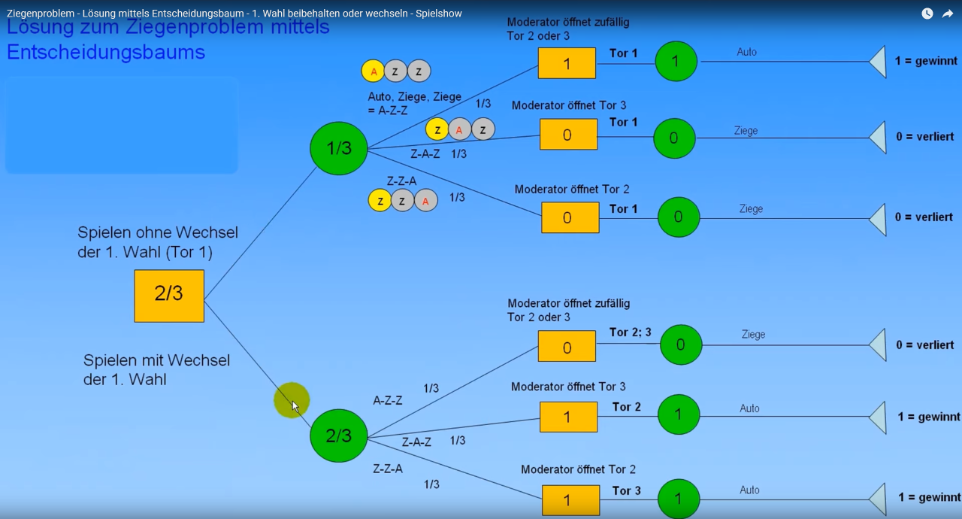

- 5.2 Bäumchen wechsel Dich

- 5.3 Nach Adam Riese

- 6 Das Beste kommt zum Schluss

- Literaturverzeichnis

Wenn der Graph lacht

Will ich oder will ich nicht?

Beim Durchforsten des Internet, von Aufsätzen und Büchern (natürlich ohne den geringsten Anspruch auf Vollständigkeit) zeigt sich nicht nur die Vielfalt der Anwendungen der Graphen in anderen Bereichen der Mathematik, der Informatik, der Naturwissenschaften und Technik, neuerlich als MINT-Fächer bezeichnet, sondern auch im täglichen Leben. Bei dieser Durchforstung fällt aber auch auf, dass die Graphentheorie selber eine Fülle von Begriffsbildungen hat und, dass diese leider nicht sehr einheitlich definiert sind. Das führt oft zu Verwirrung und damit zu Verständnisschwierigkeiten, denn nichts ist beim Lernen schlimmer, als Vorstellungen, die man mit einem bestimmten Begriff verbindet, mal so und mal anders assoziieren zu müssen und gerade in der Mathematik kommt es ja oft auch auf Kleinigkeiten an.

Will ich nun oder will ich nicht?

Keine Frage, sonst hättet Ihr ja diesen Post nicht auf meiner Seite gefunden; viel wichtiger ist die Frage: "Was will ich denn?" Ich glaube, es hat in diesem Fall keinen Zweck, ein anderes Ziel anzustreben, als die Vielfalt dieser Theorie und ihrer Anwendungen ausschnittsweise darzustellen; das will ich versuchen.

Ach ja, ich schreibe Graph nach wie vor mit "ph" und nicht mit "f", um mich nicht der Frage auszusetzen, was ich mache, wenn der Graf stirbt ...

0 Graphen in Wort und Bild

Bemerkung: Beim MouseOver über eine Abbildung erscheint eine kurze Beschreibung.

Vielfach kommen auch Mischformen vor, z.B. gerichtete Mulitigraphen oder gewichtete Bäume oder, oder, oder...

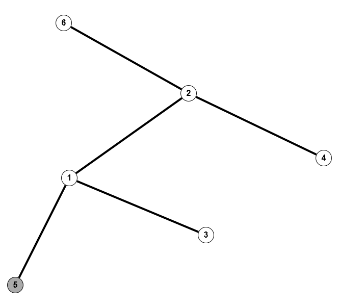

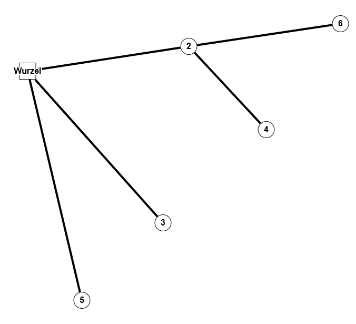

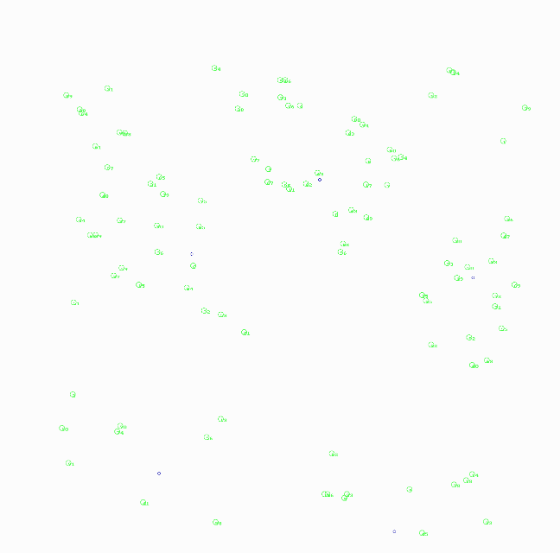

Auch die Anordnung von Knoten und Kanten kann zu speziellen Typen von Graphen führen, beispielsweise bipartite Graphen, Graphen mit isolierten Knoten oder Graphen mit mehreren Zusammenhangskomponenten oder Graphen, die als Wald oder Baum bezeichnet werden (siehe Bildkommentare):

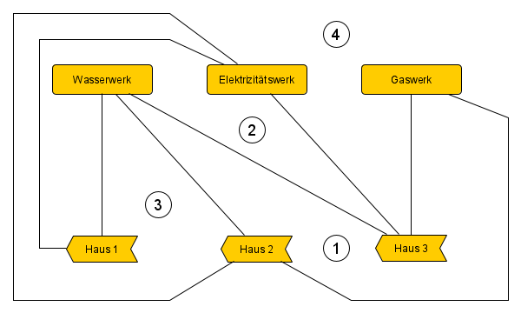

Was macht man mit Graphen? Die Antwort auf diese Frage ist mindestens so vielfältig, wie die unterschiedlichen Graphentypen. Ein großer Bereich von Anwendungen wird in der Informatik behandelt, was dann meistens mit Algorithmen verbunden ist, die bestimmte, konkrete Probleme lösen sollen. Schlagworte an dieser Stelle sind Heiratsproblem, kürzeste Wege, Travelling Salesman, Spieltheorie. Aber auch in der Mathematik werden Graphen nicht nur zur Visalisierung eingesetzt, sondern auch zur Problemlösung und Beweisführung.

Aber jeder Autor, der Graphentheorie verwenden will, macht sich seine eigenen Definitionen und Sätze und benutzt nur den Teil dieser Theorie, den er braucht und biegt die Begriffe, wie schon oben erwähnt so hin, dass sie ihm passen. Zugegeben eine rein abstrakte Behandlung von Graphen ist auf die Dauer langweilig, wo sich doch gerade hier die Visualisierung anbietet.

Sei es, wie es sei. Ich will versuchen, einen guten Mittelweg in der Theorie zu finden und natürlich die Anwendungen nicht vernachlässigen.

1 Graphen und Mathematik

Kardinalität

Sei $M$ eine Menge. Dann bedeutet $|M|$ die Anzahl der Elemente von $M$. Wir setzen $|M|=\infty$ wenn $M$ nicht endlich ist.

Potenzmenge

Sei $M$ eine Menge. Dann heißt:

$\mathfrak{P}(M)=\{A | A \subseteq M\}$ die Potenzmenge von M, also die Menge aller Teilmengen von $M$ und

$\mathfrak{P}_k(M) = \{A | A\subseteq M, \; |A| = k \}$ die Menge aller k-elementigen Teilmengen von $M$.

Beachte: $\{a,b\} = \{b,a\} = \{a,b,a\} = \{b,b,a\}$.

Kartesisches Produkt

Seien $A$ und $B$ Mengen. Dann heißt:

$A \times B =\{(a,b) | a \in A, \; b \in B \}$ das kartesische Produkt von $A$ und $B$, also die Menge aller geordneten Paare, die man aus $A$ und $B$ bilden kann.

Beachte: $(a,b) \neq (b,a)$.

Relation

Eine Relation $R$ ist eine Teilmenge eines kartesischen Produktes: $R \subseteq A \times B$.

Äquivalenzrelation

Eine Äquivalenzrelation ist eine Relation auf einer Menge $M$, die reflexiv ($\forall x \in R: (x,x) \in R$), symmetrisch ($ \forall x,y \in R: (x,y) \in R \Rightarrow (y,x) \in R$) und transitiv ($\forall x,y, z \in R: (x,y) \in R \wedge (y,z) \in R \Rightarrow (x,z) \in R$) ist.

Eine Äquivalenzklasse ist eine Teilmenge von $M$, die aus allen zu einem festen Element $x \in M$ äquivalenten Elementen besteht: $[x] = \{y \in M | (x,y) \in R\}$. Die Äquivalenzklassen bilden eine Zerlegung von $M$, d.h. $M$ ist gleich der disjunkten Vereinigung aller Äquivalenzklassen.

Natürliche Zahlen

$\mathbb{N} = \{1, 2, 3, \dots \}$

$\mathbb{N}_0 = \{0, 1, 2, 3, \dots \}$

$\mathbb{N}_k = \{1, 2, 3, \dots, k\}, \; k \neq 0 $

Definition 1.1 (Graph, Knoten, Kante)

Ein Graph $G$ ist ein geordnetes Paar $(V,E)$ aus einer Menge $V$, den Knoten (Vertex) und einer Menge $E$, den Kanten (Edge). Ist $V$ leer, dann spricht man von einem leeren Graphen.

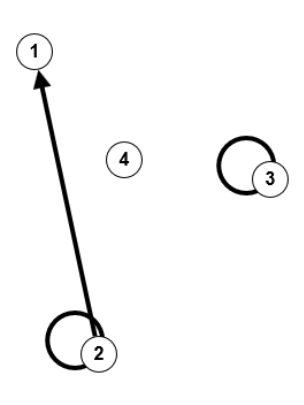

Dabei unterscheidet man folgende Typen von Graphen:

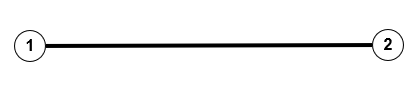

Ungerichteter Graph ohne Mehrfachkanten

$E \subset \mathfrak{P}_2(V) $, E besteht also aus 2-elementigen Mengen, die jeweils eine Kante darstellen.

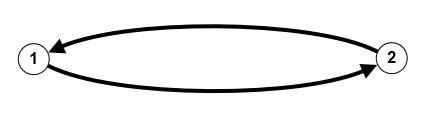

Gerichteter Graph ohne Mehrfachkanten

$E \subset V \times V$, E besteht also aus geordneten Paaren, die jeweils eine Kante darstellen und eine Orientierung haben.

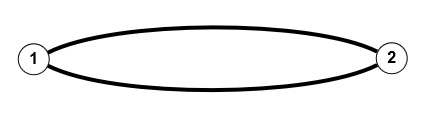

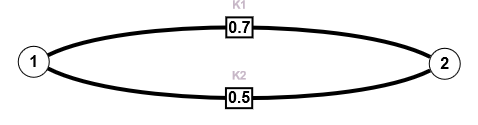

Ungerichteter Graph mit Mehrfachkanten (ungerichteter Multigraph)

$E: \mathfrak{P}_2(V) \rightarrow \mathbb{N}_0$, E besteht also aus ungerichteten Kanten verbunden mit einer Vielfachheit aus $\mathbb{N}_0$.

Beachte: Eine Abbildung ist eine Relation und damit auch eine Menge!

Gerichteter Graph mit Mehrfachkanten (gerichteter Multigraph)

$E: V \times V \rightarrow \mathbb{N}_0$, E besteht also aus gerichteten Kanten verbunden mit einer Vielfachheit aus $\mathbb{N}_0$.

Ende der Definition 1.1.

Diese häufig zu findende Definition hat den Nachteil, dass ihre formale Korrektheit erst durch die Defintion der 4 spezielle Typen hergestellt wird. Die Definition lässt zu, dass $V = \{1,2,4\}$ und $E=\{4\}$, was sicher keinen sinnvollen Graphen ergibt. Deshalb ist es besser, gleich eine übergreifende Beschreibung zu verwenden, die alle Fälle abdeckt und dann spezialisiert wird. Dies leistet:

Definition 1.1'

Ein Graph $G$ ist ein geordnetes Paar $(V,\mathfrak{E})$ aus einer Menge $V$, den Knoten (Vertex) und einer (Kanten-)Abbildung $\mathfrak{E}: V \times V \rightarrow \mathbb{N}_0$.

$e=(u,v) \in V \times V$ heißt Kante von $G$, wenn $\mathfrak{E}(u,v) > 0$ und Mehrfachkante, wenn $\mathfrak{E}(u,v) > 1$.

Die Kantenmenge ist definiert als $E := \{(u,v) | \mathfrak{E}(u,v) > 0\}$.

Ende der Definition 1.1'.

1.1' entspricht zunächst der des gerichteten Graphen mit Mehrfachkanten, ist aber so allgemein, dass man die oben genannten 4 Spezialfälle einordnen kann.

$G$ heißt ungerichtet, wenn für alle Knoten $u,v \in V $ gilt: $\mathfrak{E}(u,v) = \mathfrak{E}(v,u)$. Dann spielt die "Richtung" einer Kante keine Rolle und man kann statt $\mathfrak{E}: V \times V \rightarrow \mathbb{N}_0$ auch $\mathfrak{E}: \mathfrak{P}_2(V) \rightarrow \mathbb{N}_0$ schreiben.

$G$ heißt ohne Mehrfachkanten, wenn für alle $u,v \in V$ gilt: $\mathfrak{E}(u,v) \leq 1$. In diesem Fall ist die Kantenmenge $E = \{(u,v) | \mathfrak{E}(u,v) = 1\} $ und man kann $E$ als Teilmenge von $ V \times V $ betrachten. (Genauer: man kann die Abbildung $\mathfrak{E}$ mit der Menge $E$ über die "charakteristische Funktion" identifizieren.)

Durch Mischung erhält man alle 4 oben definierten Fälle.

Für den häufigen Fall eines ungerichteten Graphen ohne Mehrfachkanten, kann man letztlich $E$ als Teilmenge von $\mathfrak{P}_2(V)$ auffassen.

(Ganz viele) Schreibweisen und Bezeichnungen:

$V=V(G)$ und $E=E(G)$

$e \in E, e=\{v,w\}$, dann heißen $v$ und $w$ Endknoten, $e=(v,w),$ dann heißt $v$ Startknoten, $w$ Endknoten, $e=(v,v)$ oder $e=\{v\}$ dann heißt $e$ Schleife.

Ein ungerichteter Graph ohne Mehrfachkanten und Schleifen heißt einfach (oder auch schlicht).

$n(G):= |V(G)| = $ Anzahl der Knoten in $G$, auch Ordnung von $G$ genannt, diese kann auch Unendlich sein.

$m(G):= |E(G)| = $ Anzahl der Kanten von G (bei Multigraphen gemäß Vielfachheit).

Ein isolierter Knoten $v \in V$ kommt in keiner Menge bzw. in keinem Paar von E vor.

Zwei Knoten $v,w \in V$ in einem ungerichteten Graphen heißen benachbart (oder adjazent oder sind Nachbarn), wenn $\mathfrak{E}(v,w) > 0$. Die zugehörige Kante $e \in E$ heißt inzident zu v und w. Ein isolierter Knoten ist zu keiner Kante inszident.

In einem gerichteten Graphen heißt $v$ Vorgänger von $w$ ($w$ Nachfolger von $v$), wenn $e=(v,w)$ eine gerichtete Kante ist.

Sei $G$ ein ungerichteter Graph, $v \in V$; dann definieren wir:

$d_G(v) := $ Summe der Vielfachheiten der benachbarten Kanten; wenn $G$ keine Mehrfachkanten hat, entspricht dies der Anzahl der benachbarten Knoten.

$d_G(v)$ heißt Grad des Knoten $v$.

$\delta(G) := min \{d_g(v)|v \in V\}$ Minimalgrad von $G$.

$\Delta(G) := max \{d_g(v)|v \in V\} $ Maximalgrad von $G$.

$d(G) := \frac{\sum_{v \in V} d_G(v)}{n(G)}$ Durchschnittsgrad von $G$.

Bemerkung

Es gilt: $d(G) = 2 \cdot m(G) / n(G)$.

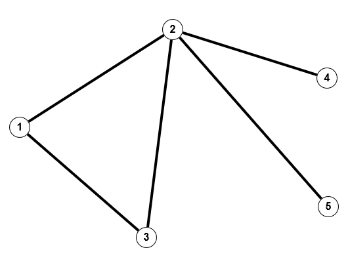

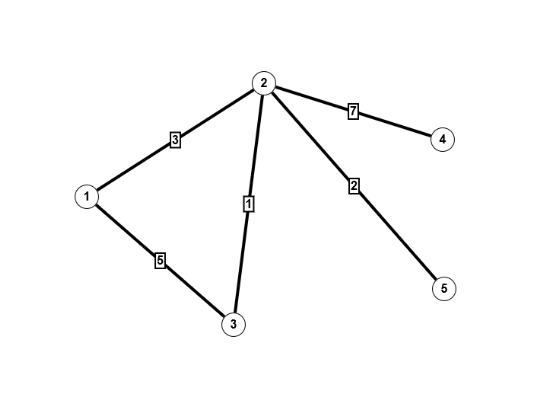

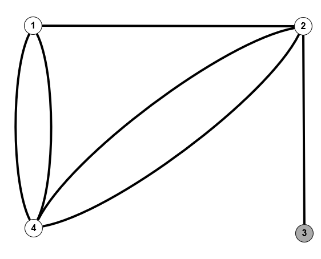

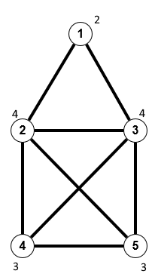

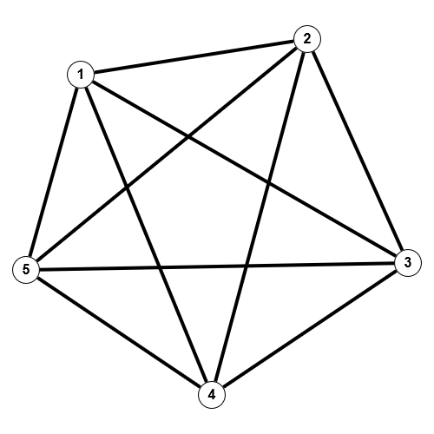

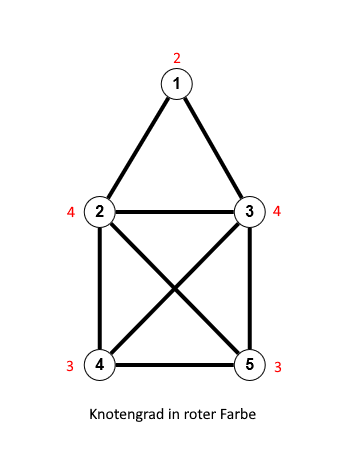

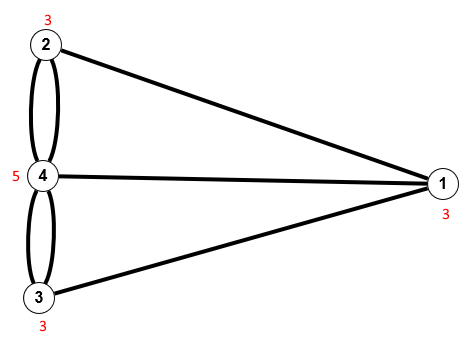

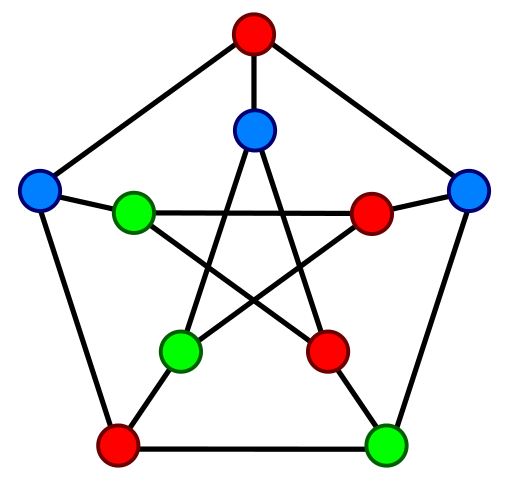

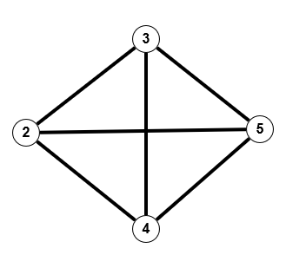

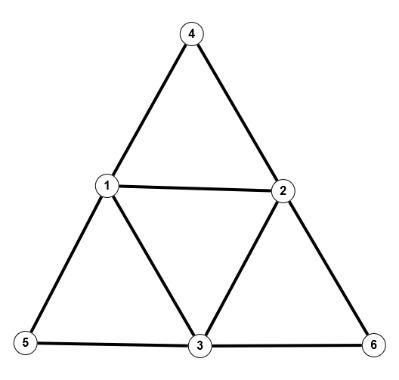

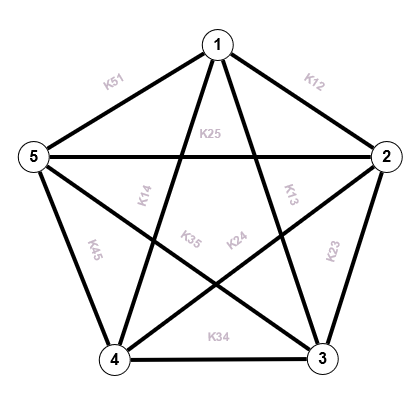

Grade des Graphen: $\delta(G) = 2, \; d(G) = \frac{16}{5}, \; \Delta(G) = 4$

Grade des Graphen: $\delta(G) = 2, \; d(G) = \frac{16}{5}, \; \Delta(G) = 4$$G$ heißt regulär, wenn alle Knoten den gleichen Grad haben, k-regulär, wenn der gemeinsame Grad k ist.

Beobachtung 1.2

$\delta(G) \leq d(G) \leq \Delta(G)$. Wenn $G$ regulär, gilt Gleichheit.

Satz 1.3

Sei $G$ ein (endlicher) ungerichteter Graph. Die Anzahl der Knoten mit ungeradem Grad ist gerade.

Beweis_1_3.pdf

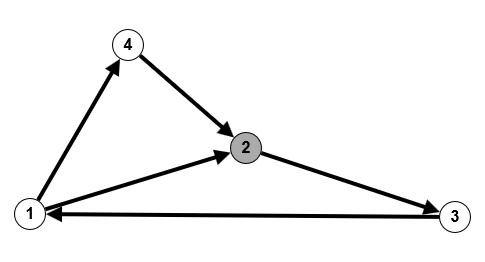

Sei $G$ ein gerichteter Graph, $v \in V$; dann definieren wir:

$d_G^-(v) :=$ Anzahl der Vorgänger von $v$, wenn $G$ keine Mehrfachkanten hat (Ausgangsgrad).

$d_G^-(v) :=$ Summe der Vielfachheiten aller Kanten in $G$ mit $v$ als Startknoten (also (v,x)), wenn $G$ Mehrfachkanten hat.

$d_G^+(v) :=$ Anzahl der Nachfolger von $v$, wenn $G$ keine Mehrfachkanten hat (Eingangsgrad).

$d_G^+(v) :=$ Summe der Vielfachheiten aller Kanten in $G$ mit $v$ als Endknoten (also (x,v)), wenn $G$ Mehrfachkanten hat.

$v$ Quelle $:\Leftrightarrow d_G^- = 0, v$ Senke $:\Leftrightarrow d_G^+ = 0$.

$v$ isoliert $:\Leftrightarrow d_G^-(v) = d_G^+(v)=0$.

Ein endlicher Graph liegt vor, wenn $|V| < \infty$. Dann ist auch die Kantenmenge endlich und dies auch in Multigraphen, da die Vielfachheitsabbildung $\mathfrak{E}$ laut Definition nicht den Wert Unendlich annimmt (Kontengrad ist immer endlich).

Alle Graphen dieses Aufsatzes sind als endlich vorausgesetzt.

Definition 1.3a (Kantengewichtsfunktion)

Sei $G=(V,E)$ ein (gerichteter oder ungerichteter) Graph. Eine Kantengewichtsfunktion ist eine Abbildung der Form

$$g: E \rightarrow \mathbb{R}$$

g(e) ist dann eine reelle Zahl und wird Kantengewicht genannt

Beispiele und Missverständnisse

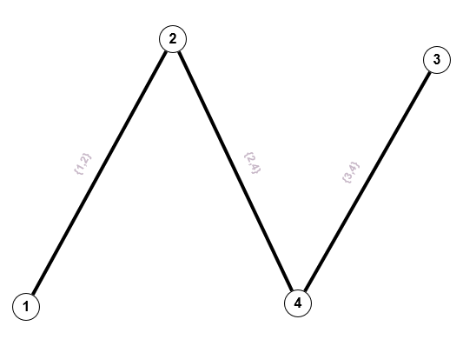

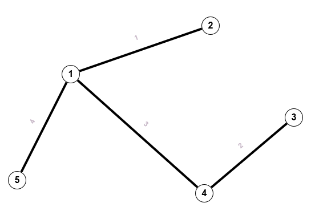

$V = \mathbb{N}_4 = \{1,2,3,4\}, \; E=\{\{1,2\},\{2,4\},\{3,4\}\}$

$V = \mathbb{N}_4 = \{1,2,3,4\}, \; E=\{\{1,2\},\{2,4\},\{3,4\}\}$ausgeräumte Missverständnisse

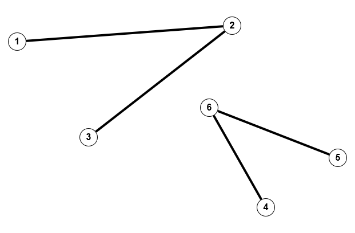

- Ein Graph kann isolierte Knoten haben, d.h. Knoten, die weder Anfangspunkt noch Endpunkt einer Kante sind.

- Sowohl die Knotenmenge als auch die Kantenmenge kann unendlich viele Element haben.

- Ein Graph muss nicht zusammenhängend sein (Definition siehe unten).

- Das Überkreuzen zweier Kanten an sich ist bedeutungslos.

- Die Winkel zwischen den Kanten haben keine Bedeutung.

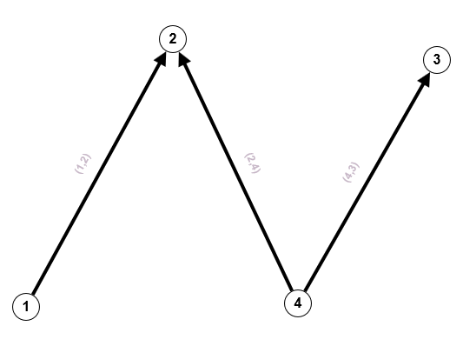

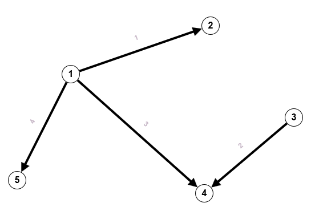

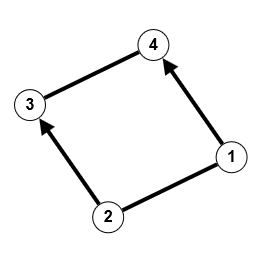

$V = \mathbb{N}_4 = \{1,2,3,4\}, \; E=\{(1,2),(2,4),(4,3)\}$

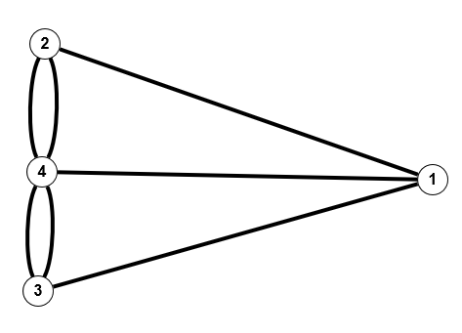

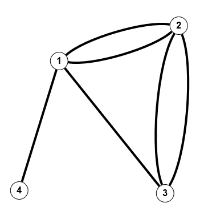

$V = \mathbb{N}_4 = \{1,2,3,4\}, \; E=\{(1,2),(2,4),(4,3)\}$ $V = \mathbb{N}_4, \; E=\{(\{1,2\},1),(\{1,3\},1),(\{1,4\},1),(\{2,4\},2),(\{3,4\},2)\}$

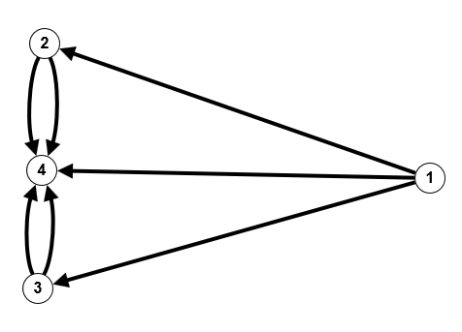

$V = \mathbb{N}_4, \; E=\{(\{1,2\},1),(\{1,3\},1),(\{1,4\},1),(\{2,4\},2),(\{3,4\},2)\}$ $V = \mathbb{N}_4, \; E=\{((1,2),1),((1,3),1),((1,4),1),((2,4),2),((3,4),2)\}$

$V = \mathbb{N}_4, \; E=\{((1,2),1),((1,3),1),((1,4),1),((2,4),2),((3,4),2)\}$ $V = \mathbb{N}_4, \; E=\{(2,1),(2,2),(3,3)\}$

$V = \mathbb{N}_4, \; E=\{(2,1),(2,2),(3,3)\}$Ausgeräumte Missverständnisse

- Schleifen können sowohl in ungerichteten als auch in gerichteten Graphen vorkommen, werden aber meisten nur in gerichteten Graphen betrachtet.

- Pro Knoten gibt es nur eine Schleife.

Es lassen sich Zusammenhänge zwischen den unterschiedlichen Graphentypen herstellen, genauer, man kann Typen aufeinander zurückführen.

- Ein ungerichteter Graph kann durch einen gerichteten Graphen ersetzt werden, indem jede ungerichtete Kante in zwei gegeneinander gerichtete Kanten zwischen den gleichen Knoten aufgelöst wird. $\{v,w\} \rightarrow (v,w), (w,v)$. Auf diese Weise kann man auch einen Graphen verstehen, in dem ungerichtete und gerichtete Knoten gemischt auftreten.

- Ein Multigraph kann in einen Graphen ohne Mehrfachkanten umgewandelt werden, indem man alle Kanten zwischen zwei Knoten bis auf eine durch einen pro Kante zusätzlich eingefügten Knoten unterteilt. $ \{v,w\}$ mit $E(\{v,w\}) = 2 \rightarrow \{v,w\} , \; \{v,v'\}, \; \{v',w\}$.

- Nimmt man 1 und 2 zusammen, so könnte man eigentlich nur gerichtete Graphen ohne Mehrfachkanten betrachten, aber vielfach ist es einfacher, doch alle definierten Typen zu verwenden.

Spezielle Graphen sind:

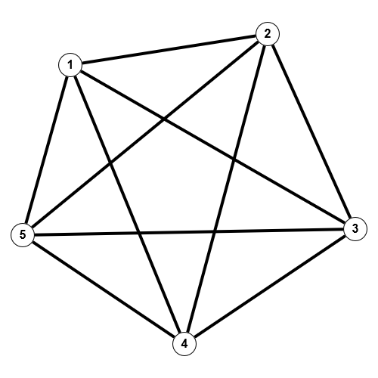

$K_n$ : der vollständige Graph auf $\mathbb{N}_n, \; n \in \mathbb{N}$, d.h. $V(K_n) = \mathbb{N}_n$ und $E(K_n) = \mathfrak{P}_2(\mathbb{N}_n)$. Somit ist $K_n$ ungerichtet, ohne Mehrfachkanten und ohne Schleifen.

Beobachtung 1.4

Jeder vollständige Graph ist regulär.

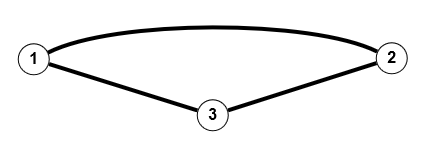

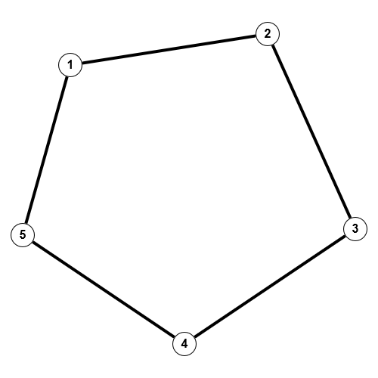

$C_n$: der Kreis-Graph oder einfach Kreis auf $\mathbb{N}_n, \; n \in \mathbb{N}, \; n \geq 3$, d.h. $V(C_n) = \mathbb{N}_n$ und $E(C_n) = \{\{i,i+1\}|1 \leq i \leq n-1\} \cup \{\{n,1\}\}$

$K_5$

$K_5$  $C_5$

$C_5$Und nun zur zweiten zentralen Definition dieses Kapitels. Man kann Graphen auf verschiedene Art und Weise zeichnen, nicht nur mit unterschiedlichen Bezeichnungen, unterschiedliche Anordnung der Knoten und Kanten usw. Deshalb muss man definieren, wann Graphen in einer bestimmten Weise "gleich" sind, der definierte Begriff heißt "isomorph".

Definition 1.5

Zwei ungerichtete Graphen $G=(V,E), G'=(V',E')$ heißen isomorph $(G \cong G')$, falls eine bijektive Abbildung $f:V \rightarrow V'$ gibt mit:

$$ \forall v,w \in V: \{v,w\} \in E \Leftrightarrow \{f(v),f(w)\} \in E'. $$

Entsprechendes definiert man für gerichtete Graphen mit Paaren statt mit 2-elementigen Mengen bzw. für Multigraphen. Bei Multigraphen ist es einfacher zu schreiben $E(\{v,w\})=E'(\{f(v),f(w)\})$ für ungerichtete und $E((v,w))=E'((f(v),f(w)))$ für gerichtete Multigraphen.

Definition 1.5' (auf der Basis der Definition 1.1')

Zwei Graphen $G=(V,\mathfrak{E}), G'=(V',\mathfrak{E'})$ heißen isomorph $(G \cong G')$, falls eine bijektive Abbildung $f:V \rightarrow V'$ gibt mit:

$$\forall v,w \in V: \mathfrak{E}(v,w) = \mathfrak{E'}(f(v),f(w)).$$

Sofern die Graphen Kantengewichtsfunktionen haben, dann müssen für Isomorphie korrespondierende Kanten auch das gleiche Gewicht haben.

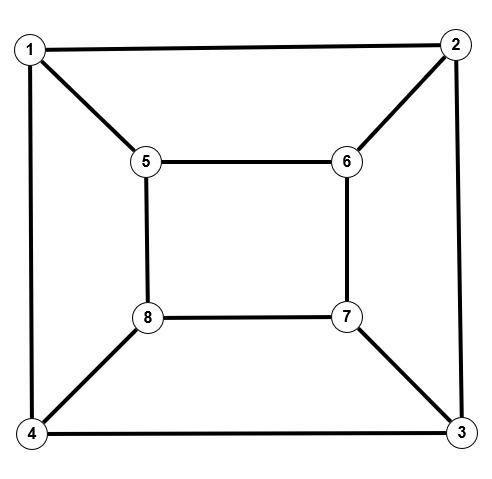

Betrachten wir als Beispiel den obigen vollständigen Graphen und einen weiteren:

Sind diese beiden Graphen isomorph? Auf den ersten Blick findet man keine große Ähnlichkeit zwischen den beiden Bildern, außer vielleicht, dass beide eben vollständig sind. Aber folgende Abbildung $f$ zeigt die Isomorphie:

$G=(V,E), \; G'=(V',E'), \; V=V'=\mathbb{N}_5, \; E=E'=\{\{1,2\},\{1,3\},\{1,4\},\{1,5\},\{2,3\},\{2,4\},\{2,5\},\{3,4\},\{3,5\},\{4,5\}\}$ und $f = id_V$.

Tatsächlich sind zwei vollständige Graphen gleicher Knotenzahl $(n(G)=n(G'))$ immer auch isomorph.

Aber auch ohne Vollständigkeit gibt es isomorphe Graphen, wie das zweite Beispiel [1] zeigt.

$P=(V,E), \; P'=(V',E'), \; V=\{A,B,C,D,E,F,G,H\}, \; V'=\{1,2,3,4,5,6,7,8\}$

$E=\{\{A,B\}, \{A,D\},\{A,F\},\{B,C\},\{B,E\},\{C,D\},\{C,H\},\{D,G\},\{E,F\},\{E,H\},\{G,G\},\{G,H\}\}$

$E'=\{\{1,2\},\{1,4\},\{1,5\},\{2,3\},\{2,6\},\{3,4\},\{3,7\},\{4,8\},\{5,6\},\{5,8\},\{6,7\},\{7,8\}$

$f(A)=1, \; f(B)=6, \;f(C)=8, \;f(D)=3, \;f(E)=5, \;f(F)=2, \;f(G)=4, \;f(H)=7$

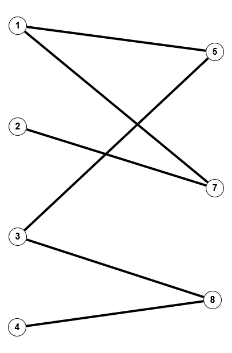

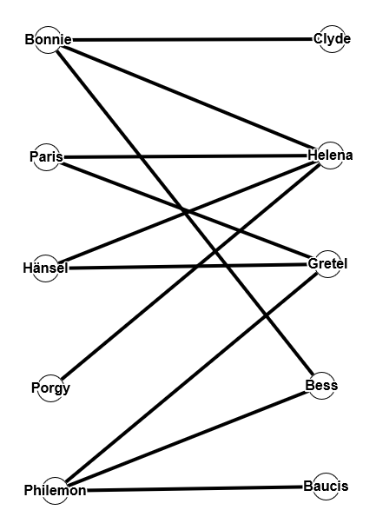

Bemerkung 1.6

Die beiden obigen Graphen haben, wie wir später noch definieren werden, eine bestimmte Struktur, die man "bipartit" nennt. Bei dem linken Graphen $P$ erkennt man dies sofort.

Satz 1.7

Die Isomorphie $\cong$ zweier Graphen $G=(V,E), G'(V',E')$ ist auf der Menge ungerichteter, einfacher Graphen mit gleicher, endlicher Mächtigkeit der Knotenmenge $(n(V)=n(V'))$ eine Äquivalenzrelation.

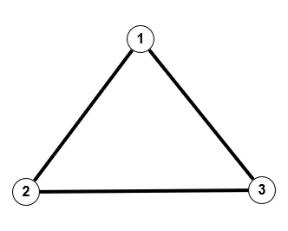

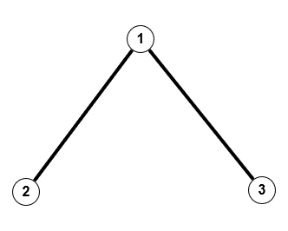

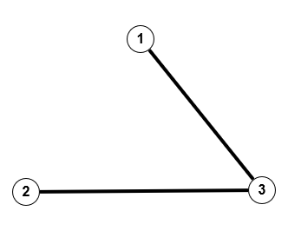

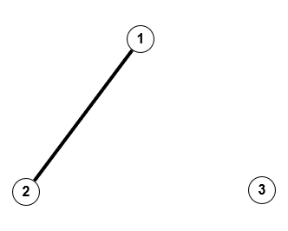

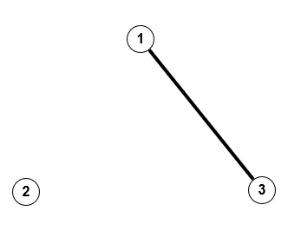

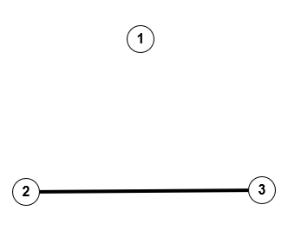

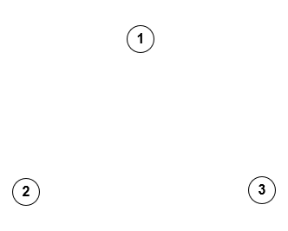

Somit gibt es eine Zerlegung in Äquivalenzklassen pro $n(V)$. Folgendes Beispiel zeigt den Fall $n=3$, für $V=\mathbb{N}_3$, wobei es auf die Knotenbezeichungen nicht ankommt.

Äquivalenzklasse mit 3 Kanten

Äquivalenzklasse mit 3 Kanten

Äquivalenzklasse mit 2 Kanten

Äquivalenzklasse mit 2 Kanten

Äquivalenzklasse mit 1 Kante

Äquivalenzklasse mit 1 Kante Äquivalenzklasse ohne Kante

Äquivalenzklasse ohne Kanteausgeräumte Missverständnisse

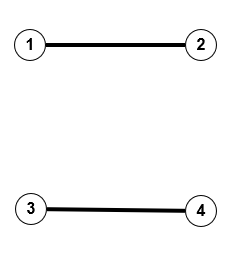

Man könnte aufgrund dieses Beispiels vermuten, dass immer Graphen mit gleicher Kantenzahl eine Äquivalenzklasse bilden. Dies ist nicht so, wie man an folgendem Beispiel für $n=4$ sieht. Die beiden Graphen haben die gleiche Kantenzahl (bei gleicher Knotenmenge), sind aber nicht isomorph.

Für den Nachweis, dass zwei gegebene Graphen isomorph sind, ist kein Algorithmus bekannt, der das in polynominaler Zeit schaffen würde. [1] Ebenso ist die Frage, wie viele Äquivalenzklasse es bei gegebenem Graphen $G$ gibt, schwierig zu beantworten. [2] Aber immerhin weiß man:

Satz 1.8

(a) $|\mathfrak{P}_2(\mathbb{N}_k)| = \binom{k}{2}$, was bedeutet, dass ein einfacher Graph mit $k$ Knoten höchstens $\frac{k(k-1)}{2}$ Kanten haben kann.

(b) Es gibt $2^{\binom{k}{2}}$-viele Graphen $G$ mit $V(G) = \mathbb{N}_k$, also $|V(G)| = k$.

(c) Der vollständige Graph $K_n$ hat $\frac{n(n-1)}{2}$ Kanten (folgt direkt aus a).

Zum Abschluss dieses Kapitels noch vier Definitionen für spätere Verwendung.

Definition 1.9 [9]

Sei $G=(V,E)$ ein Graph. Ein Teilgraph $G' \text{ von } G$ ist ein Graph $(V',E')$ mit $V' \subset V(G)$ und $E' \subset E(G).$ Wenn der Teilgraph $G'$ zwischen seinen Knoten die gleichen Kanten hat wie $G$ (also $\forall v,w \in V(G'): \{v,w\} \in E(G') \Leftrightarrow \{v,w\} \in E(G)$), dann nennt man $G'$ induzierten Teilgraph oder auch Untergraph. (Entsprechende Definition für gerichtete und Multigraphen). Also muss man für einen (induzierten) Untergraphen nur seine Knotenmenge angeben.

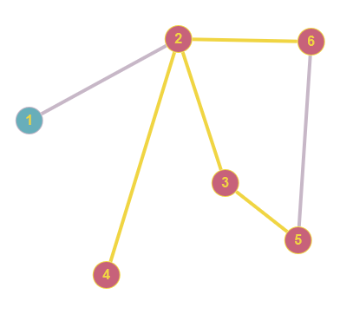

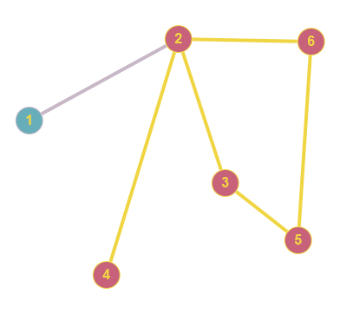

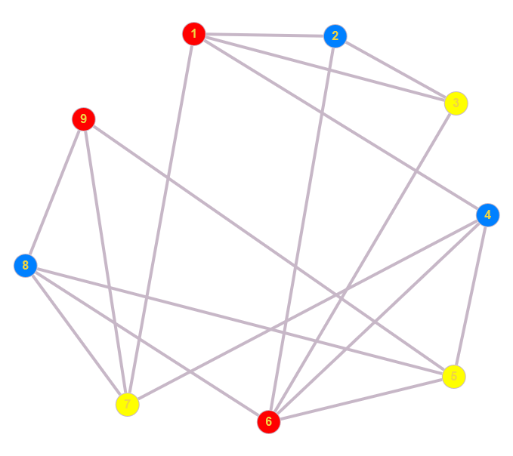

Obige Abbildung zeigt links einen Teilgraphen (rote Knoten, gelbe Kanten), rechts einen Untergraphen.

Definition 1.11

Sei $p \in \mathbb{N}$ mit $p \leq n(G)$. Dann heißt ein Untergraph $C$ von $G$ mit $C \cong K_p$ eine p-Clique in $G$. $C$ ist ein induzierter Untergraph.

Um den Begriff des Zusammenhanges definieren zu können benötigt man den Begriff des Weges.

Definition 1.12 (Weg)

Sei $G = (V,E)$ Graph (egal ob gerichtet oder nicht, egal ob Mehrfachkanten vorkommen) und $W=(v_1, \cdots, v_n)$ ein n-Tupel von Knoten aus $V$, sodass für alle $i \in \{1, \cdots, n-1\}$ gilt:

- $\{v_i, v_{i+1}\} \in E$, falls $G$ ungerichteter Graph ohne Mehrfachkanten ist

- $(v_i, v_{i+1}) \in E$, falls $G$ gerichteter Graph ohne Mehrfachkanten ist

- $E(\{v_i, v_{i+1}\}) > 0$, falls $G$ ungerichteter Graph mit Mehrfachkanten ist

- $E((v_i, v_{i+1})) > 0$, falls $G$ ungerichteter Graph mit Mehrfachkanten ist.

$v_i$ und $v_{i+1}$ sind also jeweils durch eine Kante verbunden. $W$ nennt man ungerichteten Weg, wenn $G$ ungerichtet ist, gerichteten Weg, wenn $G$ gerichtet ist. $v_1$ heißt Startknoten, $v_n$ Endknoten des Weges. Als Weglänge bezeichnen wir die Anzahl der Kanten des Weges.

In Definition 2.1 wird dieser Begriff wiederholt und spezielle Wege eingeführt.

Definition 1.13 (Zusammenhang)

Ein ungerichteter Graph $G$ heißt zusammenhängend, wenn es zwischen je zwei beliebigen Knoten aus $V$ einen ungerichteten Weg in $G$ gibt, der sie verbindet.

Ein gerichteter Graph $G$ heißt stark zusammenhängend, wenn für je zwei beliebige Knoten $u$ und $v$ aus $V$ sowohl einen gerichteten Weg von $u$ nach $v$ gibt, als auch umgekehrt.

Ein gerichteter Graph $G$ heißt schwach zusammenhängend, wenn der zugehörige ungerichtete Graph zusammenhängend ist.

Eine Zusammenhangskomponente $U$ eines Graphen $G$ ist ein maximal zusammenhängender Untergraph, d.h. es gilt:

1.) Der Untergraph $U$ ist zusammenhängend

2.) Für jeden Knoten $v \in G \setminus U$ ist der Untergraph $U \cup \{v\}$ nicht zusammenhängend.

Bemerkung

Man kann die Eigenschaft, dass zwei beliebige Knoten durch einen Weg in $G$ verbunden sind, als Äquivalenzrelation auf V auffassen. Die daraus entstehenden Äquivalenzklassen ergeben die Zusammenhangskomponeneten, wenn man von den Äquivalenzklassen zu den durch sie induzierten Teilgraphen (=Untergraphen) von $G$ übergeht. [44]

1.1 Adjazenz, Inzidenz, Laplace und Grad

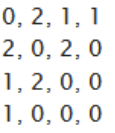

Definition 1.14 (Adjazenzmatrix) [14]

Sei $G=(V,E)$ ein Graph, $n=n(G), V=\mathbb{N}_n, A=(a_{i,j}), \; i, j \in \mathbb{N}_n.$ Die Festlegung der Knotennamen auf die ersten $n$ natürlichen Zahlen ist im Sinne der Isometrie durch Umbenennung immer möglich.

Dann nennen wir $A \in \mathbb{R}^{n\times n}$ Adjazenzmatrix (auch $A(G)$), wenn in

a) Graphen ohne Kantengewichte, ohne Mehrfachkanten

$$a_{i,j}=\begin{cases}

1 \text{ falls } (i,j) \in E \text{ bzw. } \{i,j\} \in E \\

0 \text{ sonst}

\end{cases}

$$

b) Graphen ohne Kantengewichte, mit Mehrfachkanten

$$

a_ {i,j}=E((i,j)) \text{ falls } (i,j) \in E \text{ bzw. } E(\{i,j\}) \text{ falls }\{i,j\} \in E \\

$$

c) Graphen mit Kantengewichten (Kantengewichtsfunktion $g$), ohne Mehrfachkanten

$$a_{i,j}=\begin{cases}

g((i,j)) \text{ falls } (i,j) \in E \text{ bzw. } g(\{i,j\}) \text{ falls } \{i,j\} \in E \\

0 \text{ sonst}

\end{cases}

$$

Für Graphen mit Kantengewichten und Mehrfachkanten definiert man keine Adjazenzmatrix.

In einer Adjazenzmatrix ist ablesbar, welche Knoten durch eine Kante verbunden sind (bze. durch wieviele Kanten zwei Knoten verbunden sind und bei c) mit welchem Gewicht sie das tut.

in den Fälle a) und b) kann man die Adjazenzmatrix als Darstellung der Funktion $\mathfrak{E}$ aus Definition 1.1' betrachten.

Aus einer Adjazenzmatrix kann man das Aussehen des Graphen qualitativ rekonstuieren, will heißen, dass man einen isomorphen Graphen erhält. Folgender Satz stellt einige grundlegende Eigenschaften von Adjazenzmatrizen zusammen.

Für die Definition eines Weges und eines Pfades siehe Definition 1.12 bzw. 2.1.

Satz 1.15

a) $G$ ungerichtet $\Leftrightarrow A$ symmetrisch

b) $G$ schleifenfrei $\Leftrightarrow a_{i,i}=0$ für alle $i=1\cdots n$

c) $G$ ungerichtet: $G$ zusammenhängend $\Leftrightarrow A$ irreduzibel

d) $G$ gerichtet: $G$ stark zusammenhängend $\Leftrightarrow A$ irreduzibel

e) $G$ gerichtet: $A^T + A $ irreduzibel $\Rightarrow G$ schwach zusammenhängend. Dann ist $A^T + A$ die Adjazenzmatrix des $G$ zugrundeliegenden ungerichteten Graphen

f) Sind zwei Adjazenzmatrizen gleich, dann sind daraus zu konstruierende Graphen isomorph.

g) Die Adjazenzmatrix des vollständigen Graphen hat auf der Hauptdiagonale Nullen und sonst überall Einsen.

h) $G$ habe keine Kantengewichte, aber Mehrfachkanten sind zugelassen (Fall b). Dann ist $A(i,j):=a_{i,j}$ die Anzahl der Wege der Länge 1 von $i$ nach $j$. Allgemein ist $A^k(i,j)$ die Anzahl der Wege der Länge k von i nach j.

i) Wenn in g) keine Mehrfachkanten erlaubt sind, dann gilt die gleiche Aussage für Pfade statt Wege

j) Sei $B = (b_{i,j}) = \sum_{i=0}^k A^i \quad (A^0=I)$ und $R_k$ definiert durch $r_{i,j}=\begin{cases} 1 \text{ für } b_{i,j} > 0 \\ 0 \text{ für } b_{i,j} = 0 \end{cases}$

Dann ist $R_k$ die Matrix, die angibt, ob ein Knoten j vom Knoten i aus in maximal k Schritten erreichbar ist, nämlich dann, wenn $r_{i,j} = 1$ ist. Wenn $R_k = R_{k+1}$, dann nennt man $R := R_n$ Erreichbarkeitsmatrix.

Ausflug in die Lineare Algebra

Der in Satz 1.15 benutzte Begriff "irreduzibel" stammt aus der linearen Algebra. Er besagt einfach ausgedrückt, dass die Matrix nicht durch Vertauschen von Zeilen und Spalten so umgeordnet werden kann, dass eine untere Blocksdreiecksgestalt entsteht. Zunächst die exakte Definition.

Definition 1.16 (reduzibel)

Eine Matrix $A \in \mathbb{R}^{n \times n}$ heißt reduzibel, wenn es eine Permutationsmatrix $P$ gibt, so dass

$$

PAP^T = \left(

\begin{array}{cc}

A_{MM} & 0 \\

A_{NM} & A_{NN}\\

\end{array}

\right)

$$

$A_{MM}$ ist eine Blockmatrix aus $\mathbb{R}^{p\times p}, p \in \{1, 2, \cdots , n-1\}$. Die anderen beiden Matrizen sind passend dimensioniert anzunehmen. Sonst heißt die Matrix irreduzibel.

Man beachte, das die Blockmatrizen $A_{MM}$ und $A_{NN}$ quadratisch sind; die 0 steht für eine rechteckige Blockmatrix, die nur Nullen enthält. Wenn z.B. $n=7$ ist und M=5, dann muss N=2 sein und die Blockmatrix mit den Nullen hat dann 5 Zeilen und 2 Spalten.

Eine Permutationsmatrix $P$ hat in jeder Zeile und jeder Spalte genau eine 1, sonst Nullen. Etwas formaler gesagt:

Definition 1.17 (Permutationsmatrix)

Sei $\pi$ eine Permutation der ersten n natürliche Zahlen. Dann ist eine Permutationsmatrix $P_\pi \in \mathbb{R}^{n \times n}$ definiert als

$P_\pi=(p_{i,j})$ mit $p_{i,j} = \delta_{\pi(i),j}$

Bemerkung

Permutationsmatrizen entstehen aus der Einheitsmatrix durch Zeilen- (oder Spalten-) Vertauschungen; eins von beidem reicht.

Eigenschaften:

Satz 1.17a

a) Eine Permutationsmatrix ist regulär und orthogonal; $P_\pi^{-1} = P_\pi^T=P_{\pi^-1}$

b) $P_{\pi \circ \sigma} = P_{\sigma} \cdot P_{\pi}$

c) Die Potenz einer Permutationsmatrix ist wieder eine Permutationsmatrix. Es gibt ein $k \in \mathbb{N}: \; P_\pi^k = I$.

d) $\det{P_\pi} = \text{sgn}(\pi)$

e) Die Eigenwerte einer Permutationsmatrix liegen auf dem komplexen Einheitskreis.

Beispiel:

$$

\pi =(1,2) \quad

P_\pi=\left(

\begin{array}{ccc}

0 & 1 & 0 \\

1 & 0 & 0 \\

0 & 0 & 1 \\

\end{array}

\right)

\quad

A=\left(

\begin{array}{ccc}

1 & 2 & 3 \\

4 & 5 & 6 \\

7 & 8 & 9 \\

\end{array}

\right)

\quad

P_\pi^T=P_\pi

\quad

P_\pi \cdot A \cdot P_\pi^T =

\left(

\begin{array}{ccc}

5 & 4 & 6 \\

2 & 1 & 3 \\

8 & 7 & 9 \\

\end{array}

\right)

$$

In diesem Beispiel werden die Zeilen 1 und 2 und die Spalten 1 und 2 vertauscht, wobei es hier egal ist, in welcher Reihenfolge das passiert.

Nun noch ein paar Eigenschaften irreduzibler Matrizen.

Satz 1.18

a) Mit $A$ ist auch $A^T$ irreduzibel.

b) Sei $A \in \mathbb{R}^{n \times n} \geq 0$ und es existiere ein $k \in \mathbb{N}: A^k > 0$. Dann ist A irreduzibel.

c) Sei $A \in \mathbb{R}^{n \times n} \geq 0$. $A$ irreduzibel $\Leftrightarrow \forall i,j \in \mathbb{N}_n \; \exists k \in \mathbb{N}: A^k(i,j) > 0$.

Da im Weiteren auch Eigenwerte von Matrizen eine Rolle spielen, hier kurz eine Zusammenstellung der dort gebrauchten Eigenschaften:

Satz 1.18b

a) Die Summe der Eigenwerte ist gleich der Spur der Matrix. Unter Spur versteht man die Summe der Hauptdiagonalelemente.

b) Eigenwert von $A^k$ = $\text{(Eigenwert von } A )^k$.

Soweit der Ausflug in die lineare Algebra.

Als Erstes ein Satz über die Isomorphie von Graphen:

Satz 1.18a [35] [41]

Seien $G_1$ und $G_2$ zwei Graphen mit derselben Knotenmenge. Die beiden Graphen sind genau dann isomorph, wenn es eine Permutationsmatrix $P$ gibt, sodass $P^T A(G_1) P = A(G_2)$. Somit haben isomorphe Graphen ähnliche Adjazenzmatrizen (da die Permutationsmatrizen regulär sind). Also haben isomorphe Graphen das gleiche charakteristische Polynom und die gleichen Eigenwerte.

Damit können wir von dem charakteristischen Polynom und den Eigenwerten eines Graphen reden.

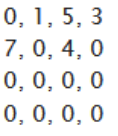

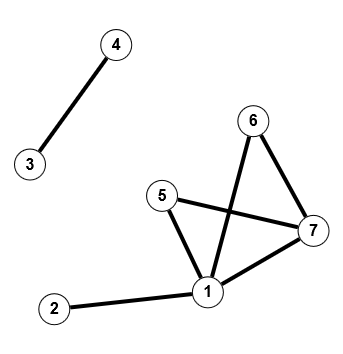

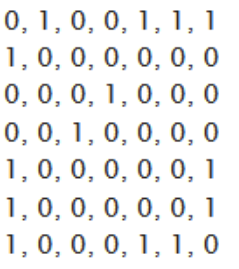

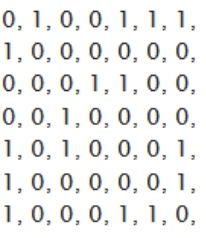

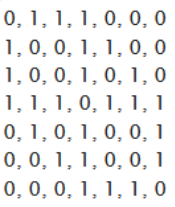

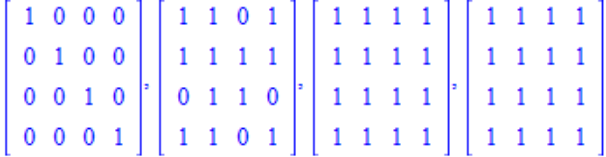

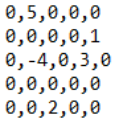

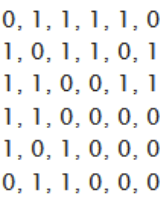

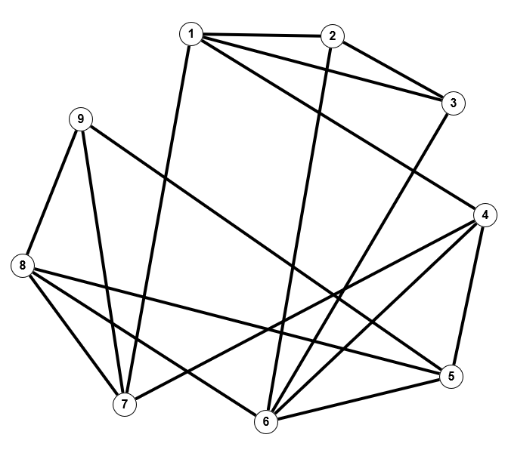

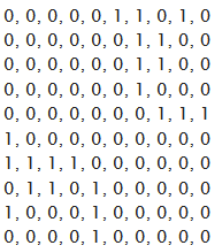

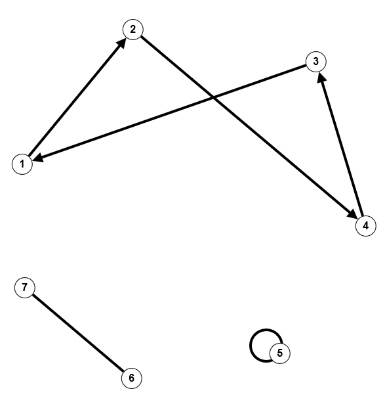

Und nun zu einem konkreten Beispiel für einen nicht zusammenhängenden Graphen und seine Adjazenzmatrix. Der folgende ungerichtete Graph ist nicht zusammenhängend, dementsprechend muss seine Adjazenzmatrix reduzibel sein.

Man sieht, dass durch Vertauschen der ersten und dritten und der zweiten und vierten Zeile eine untere Blockdreiecksmatrix entsteht. Das gleichzeitige Tauschen der zugehörigen Spalten ändert in diesem Fall daran nichts, muss aber gemacht werden, da ja $P\cdot A \cdot P^T$ gefordert ist; also:

$$

P=\left(

\begin{array}{ccccccc}

0&0&1&0&0&0&0\\

0&0&0&1&0&0&0\\

1&0&0&0&0&0&0\\

0&1&0&0&0&0&0\\

0&0&0&0&1&0&0\\

0&0&0&0&0&1&0\\

0&0&0&0&0&0&1\\

\end{array}

\right),

\quad

P^T=P,

\quad

P \cdot A \cdot P^T =

\left(

\begin{array}{ccccccc}

0&1&0&0&0&0&0\\

1&0&0&0&0&0&0\\

0&0&0&1&1&1&1\\

0&0&1&0&0&0&0\\

0&0&1&0&0&0&1\\

0&0&1&0&0&0&1\\

0&0&1&0&1&1&0\\

\end{array}

\right)

\quad

A_{2,2}=

\left(

\begin{array}{cc}

0&1\\

1&0\\

\end{array}

\right)

\quad

A_{5,5}=\left(

\begin{array}{ccccc}

0&1&1&1&1\\

1&0&0&0&0\\

1&0&0&0&1\\

1&0&0&0&1\\

1&0&1&1&0\\

\end{array}

\right)

\quad

A_{5,2}=

\left(

\begin{array}{cc}

0&0\\

0&0\\

0&0\\

0&0\\

0&0\\

\end{array}

\right)

$$

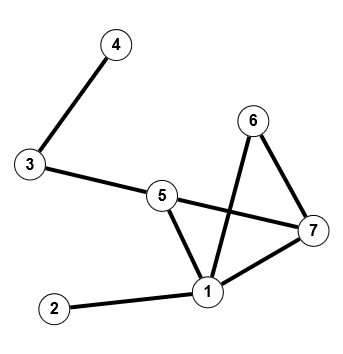

Verbindet man andererseits die beiden Zusammenhangskomponenten des obigen Graphens kann man mit Hilfe von Satz 1.18 die Irreduzibilität zeigen:

Durch Multiplikation der Adjazenzmatrix mit sich selbst erhält man bei $A^6$ eine Matrix mit lauter positiven Elementen, damit ist der Graph zusammenhängend. Ihre tatsächlichen Werte sind ohne Belang und werden hier nicht wiedergegeben.

Da einem Graphen eine Matrix zugeordnet ist, kann man sich fragen, welche anderen Eigenschaften von Matrizen auch für Graphen interessant sind bzw. auf Graphen übertragen werden können. Die Spektrale Graphentheorie [15] befasst sich mit dieser Frage, indem sie Aussagen über die Eigenwerte von Adjazenzmatrizen macht.

Definition 1.19 (Charakteristisches Polynom, Eigenwerte)

Sei $G$ ein ungerichteter Graph. $A_G$ sei die zugehörige Adjazenzmatrix. Dann wird das charakteristische Polynom $P_G(x) = \det(A_G - x \cdot I)$ von $A_G$ auch charakteristisches Polynom von $G$ genannt; ebenso werden die Eigenwerte von $A_G$ Eigenwerte des Graphen genannt. Die Menge der Eigenwerte bildet das Spektrum des Graphen.

Satz 1.20

a) Ein ungerichteter Graph $G$ hat nur reelle Eigenwerte.

b) Der vollständige Graph $K_n$ hat das Spektrum $\lambda_1 = n-1, \; \lambda_2 = \cdots = \lambda_n = -1$.

c) Der vollständige bipartite Graph (siehe Definition 3.3) $K_{r,s}$ hat das Spektrum $\lambda_1 = \sqrt{r\cdot s}, \; \lambda_2 = \lambda_3 = \cdots = \lambda_{r+s-1} = 0, \; \lambda_{r+s}=-\sqrt{r \cdot s}$.

d) $G$ habe die Zusammenhangskomponenten $G_1, \cdots , G_r$. Dann gilt für das charakteristische Polynom

$P_G(x) = P_{G_1}(x) \cdot P_{G_2}(x) \cdots P_{G_r}(x)$. Somit bestimmt das Spektrum der Zusammenhangskomponenten das Spektrum des gesamten Graphens.

e) Bei einem schleifenfreien Graphen ist die Summe der Eigenwerte gleich Null. (Siehe Satz 1.18b a)

f) Für jeden Eigenwert $\lambda$ von $G$ gilt $|\lambda| \leq \Delta(G)$ (Maximalgrad).

g) $G$ hat genau dann den Eigenwert $\Delta(G)$, wenn $G$ regulär ist.

h) Ist $-\Delta(G)$ ein Eigenwert von $G$, dann ist $G$ regulär und bipartit.

i) Ein bipartiter Graph $G$ hat mit einem Eigenwert $\lambda$ stets auch $-\lambda$ als Eigenwert von $G$.

j) Haben zwei Graphen unterschiedliche Eigenwerte, sind sie nicht isomorph.

k) Bei einem ungerichteten Graphen $G$ gilt für seine Adjazenzmatrix $A$:

(1) Spur($A$) = 0

(2) Spur($A^2$) = 2 m(G) (= 2 mal die Anzahl der Kanten)

(3) Spur($A^3$) = 6 $\cdot$ Anzahl der Dreiecke von $G$.

Der Zusammenhang zu den Eigenwerten besteht in Punkt e). Darüber hinaus folgt, dass das Spektrum die Anzahl der Kanten, Knoten und Dreiecke festlegt. (Siehe Satz 1.18b b))

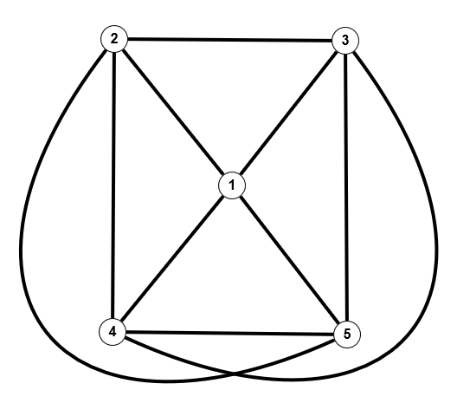

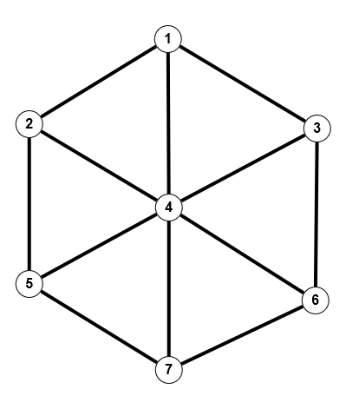

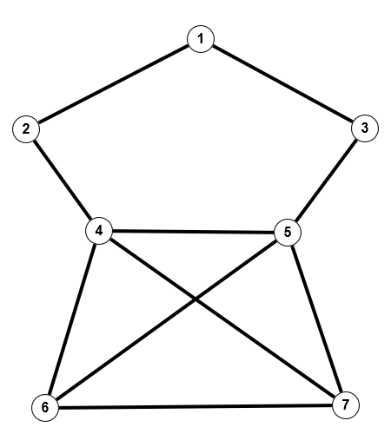

Leider bestimmt das Spektrum eines Graphen nicht eindeutig seine Struktur (im Sinne der Isomorphie, Satz 1.20j ist keine Äquivalenz). Dies sei an einem Beispiel kurz gezeigt.

Dass die beiden Graphen nicht isomorph sind sieht man leicht am Knoten 4 des linken Graphen, der den Grad 6 hat; einen Knoten mit diesem Grad gibt es beim rechten Graphen nicht. Beide Graphen haben das gleiche Charakteristische Polynom $p(\lambda) = (\lambda + 2)(\lambda^2 - 2\lambda - 6)(\lambda - 1)^2(\lambda + 1)^2$ und damit auch die gleichen Eigenwerte $\{-2, 1 \pm \sqrt(7), 1,1,-1,-1\}$.

Aber was kann man mit dieser Spektraltheorie denn nun anfangen? Ich habe den Hinweis gefunden, dass es für das automatisierte Zeichnen von Graphen ein Verfahren gibt, das sog. Spektral-Layout, das Eigenwerte und Eigenvektoren der Adjazenzmatrix (oder auch der später eingeführten Laplace-Matrix) benutzt, um Graphen ausgehend von der Adjazenzmatrix zu zeichnen. Ja, es ist tatsächlich keine uninteressante Fragestellung, wie man aus der Adjazenzmatrix, die ja bis auf Isomorphie das Aussehen des Graphen bestimmt, automatisiert eine Zeichnung des Graphen erstellen kann. Hier wird in [15] ein Algorithmus von Hall [16] genannt; eine andere Lösung findet sich in [17].

Ich werde auf dieses Verfahren in einem eigenen Kapitel eingehen und setze hier zunächst die Vorstellung weiterer Darstellungsmatrizen für Graphen fort.

Die Inzidenzmatrix sagt etwas über das Zusammentreffen von Knoten und Kanten aus.

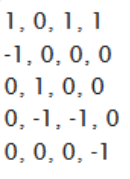

Definition 1.21 (Inzidenzmatrix) [18]

Sei $G=(V,E)$ kein Multigraph, $\quad n=n(G),\; m=m(G)$. Eine Matrix $B=(b_{i,j}) \in \mathbb{R}^{n \times m}$ heißt Inzidenzmatrix, wenn

a) für schleifenfreie ungerichtete Graphen $ b_{i,j} = \begin{cases} 1 \text{ falls } v_i \in e_j \\ 0 \text{ sonst} \end{cases}$

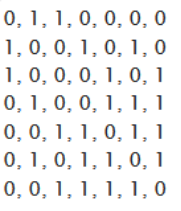

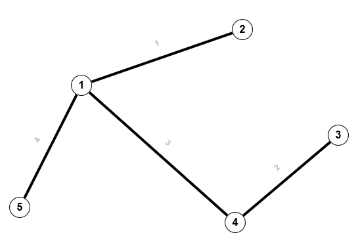

Die Inzidenzmatrix ist 5x4.

Die Inzidenzmatrix ist 5x4.b) für schleifenfreie gerichtete Graphen $b_{i,j} = \begin{cases} 1 \text{ falls } \exists x \in V:e_j =(v_i,x) \\ 0 \text{ falls } v_i \notin e_j \\

-1 \text{ falls } \exists x \in V:e_j =(x,v_i) \end{cases}$ mit beliebigem Knoten x.

Die Inzidenzmatrix ist 5x4.

Die Inzidenzmatrix ist 5x4.Beobachtung 1.22

a) In einer Inzidenzmatrix eines ungerichteten Graphen enthält jede Spalte genau 2 von Null verschiedene Einträge, deren Summe 2 ergibt.

b) In einer Inzidenzmatrix eines gerichteten Graphen enthält jede Spalte genau 2 von Null verschiedene Einträge, deren Summe 0 ergibt.

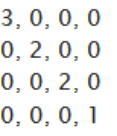

Definition 1.23 (Gradmatrix)

Sei $G=(V,E), \quad n=n(G)$. Eine Diagonalmatrix $D=(d_{i,i}) \in \mathbb{R}^{n \times n}$ heißt Gradmatrix, wenn $d_{i,i} = d_G(v_i)$.

Zu dem Graphen unter Definition 1.21 gehört folgende Gradmatrix:

Satz 1.24

Sei $G$ ein ungerichteter Graph, B seine Inzidenzmatrix, A seine Adjazenzmatrix und D seine Gradmatrix. Dann gilt:

$$

A + D = B \cdot B^T

$$

Als letztes betrachten wir nun noch die Laplace-Matrix, die in gewisser Weise die Gradmatrix und die Adjazenzmatrix vereinigt.

Definition 1.25 (Laplacematrix) [19]

Sei $G=(V,E) \text{ einfacher Graph, } n=n(G)$. Eine Matrix $L=(l_{i,j}) \in \mathbb{R}^{n \times n}$ heißt Laplace-Matrix, wenn

$ l_{i,j} = \begin{cases} d_G(v_i) \text{ falls } i = j \\ -1 \text{ falls } i \neq j \text{ und } v_i \text{ benachbart zu } v_j \\ 0 \text{ sonst} \end{cases}.$

Satz 1.26

Sei $G$ einfacher Graph mit Adjazenzmatrix $A$, Gradmatrix $D$ und Inzidenzmatrix $B$. Dann gilt:

a) $L = D - A$

b) Wenn $G$ d-regulär ist, dann gilt speziell $L = d \cdot I - A$

c) $L = B^T\cdot B$

d) $L$ ist symmetrisch, damit sind alle Eigenwerte reell

e) $L$ ist positiv-semidefinit (was bedeutet, dass alle Eigenwerte von $L$ nichtnegativ sind)

f) Die Spalten- und die Zeilensummen von $L$ sind Null.

g) Der kleinste Eigenwert von $L$ ist 0, der zugehörige Eigenvektor ist $\alpha \cdot 1_n, \; 1_n:=(1,1,1, \cdots, 1)^T$

h) Die algebraische Vielfachheit dieses Eigenwertes 0 ist die Anzahl der Zusammenhangskomponenten von $G$.

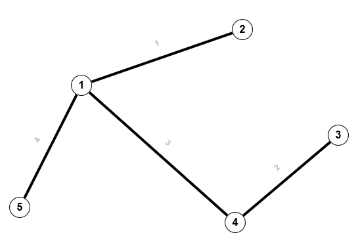

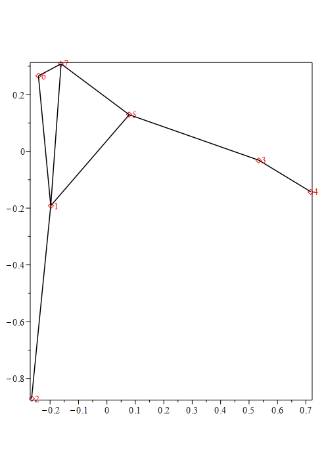

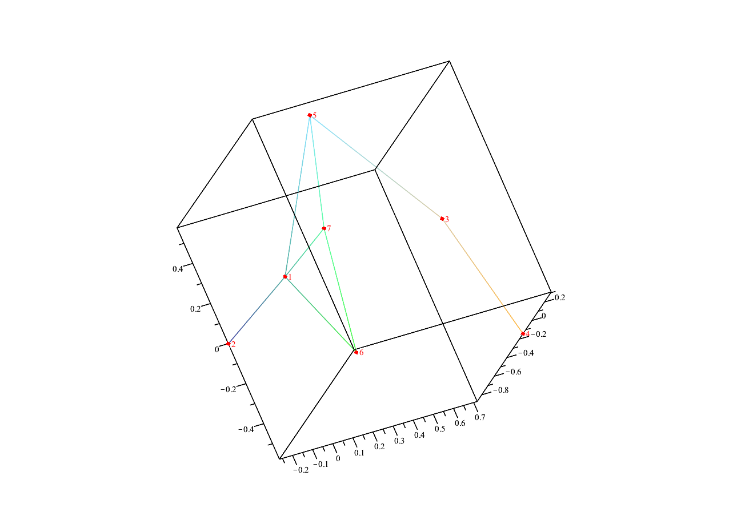

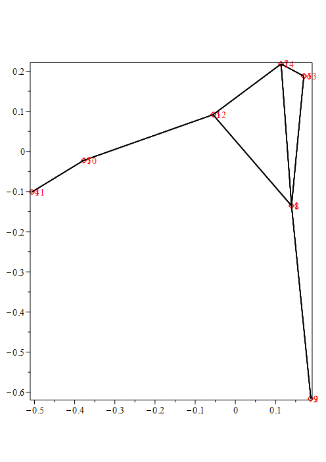

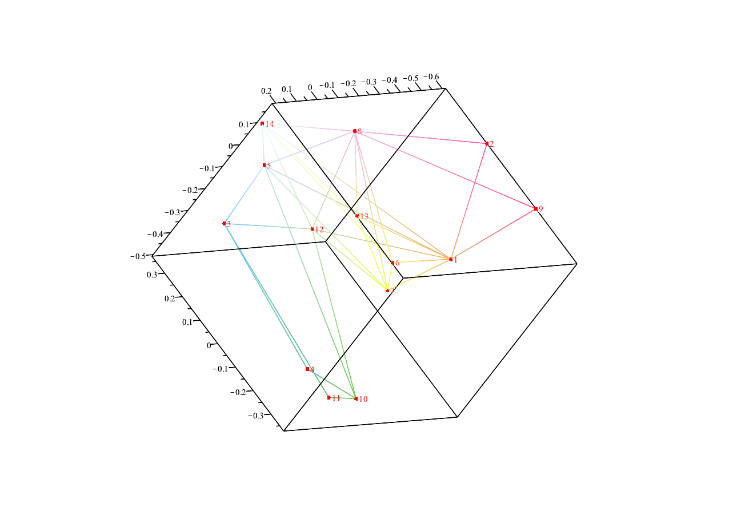

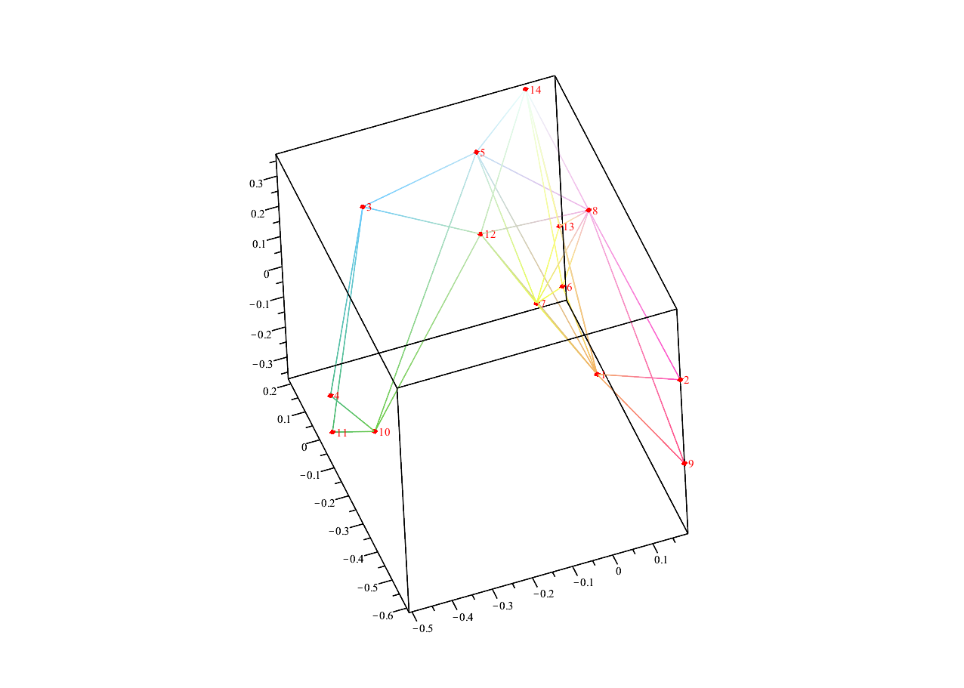

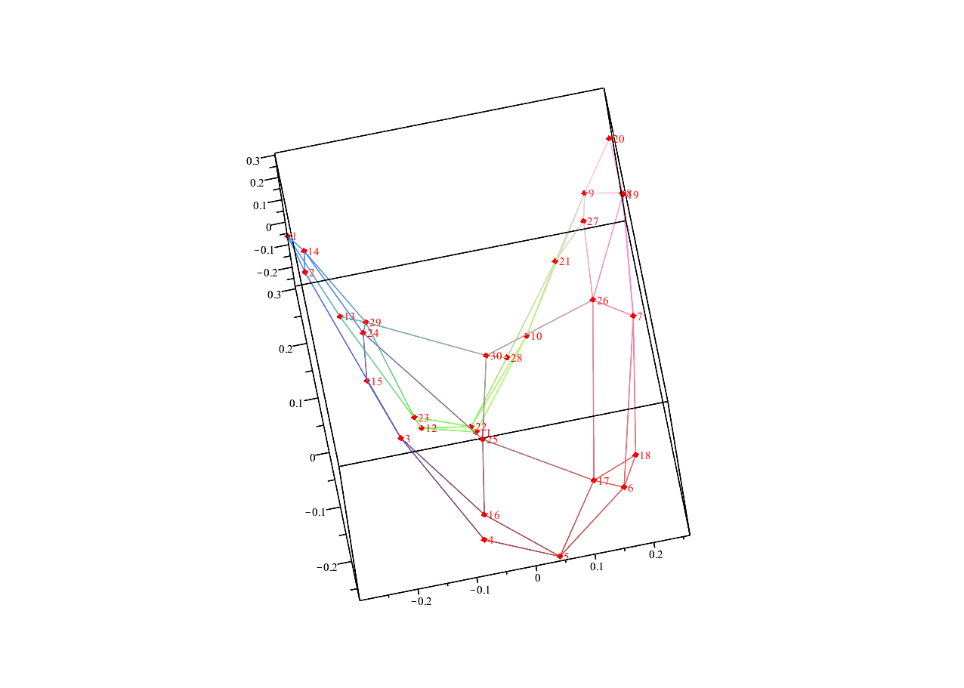

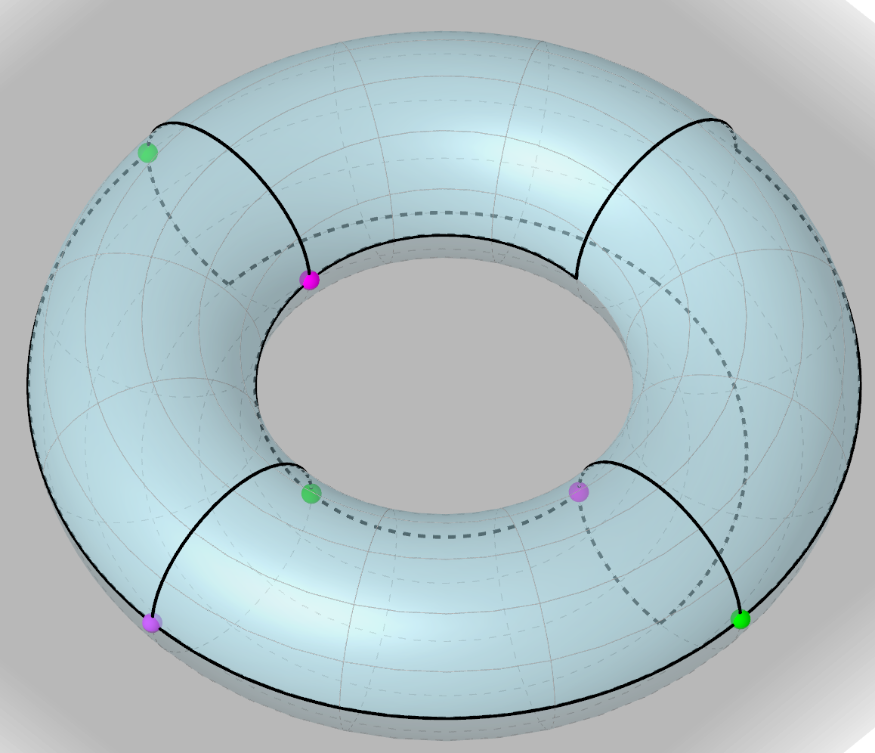

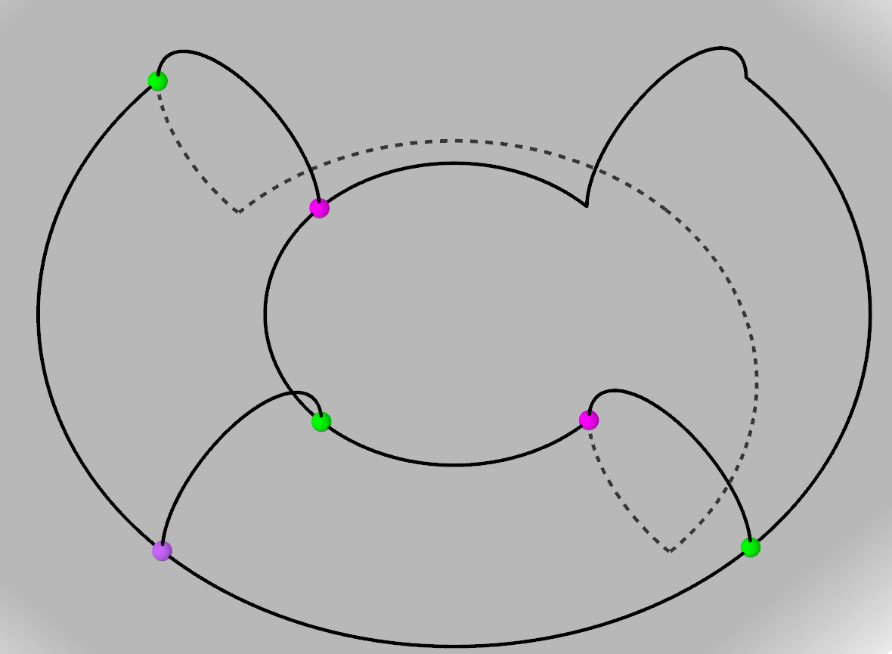

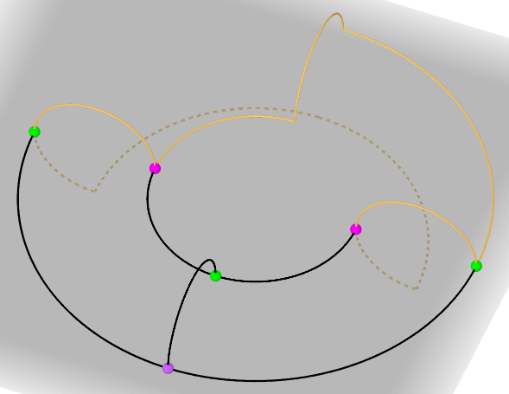

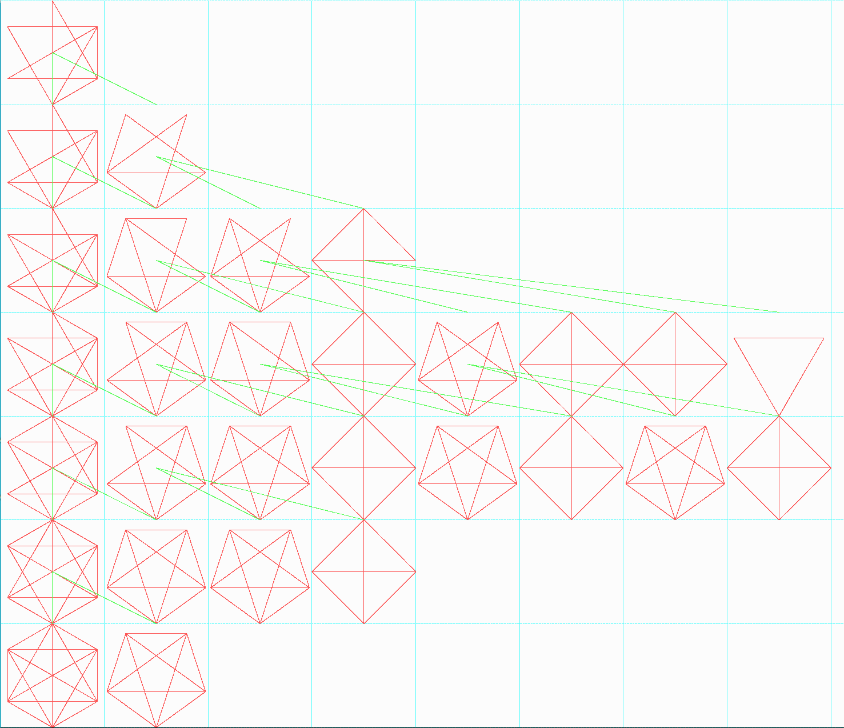

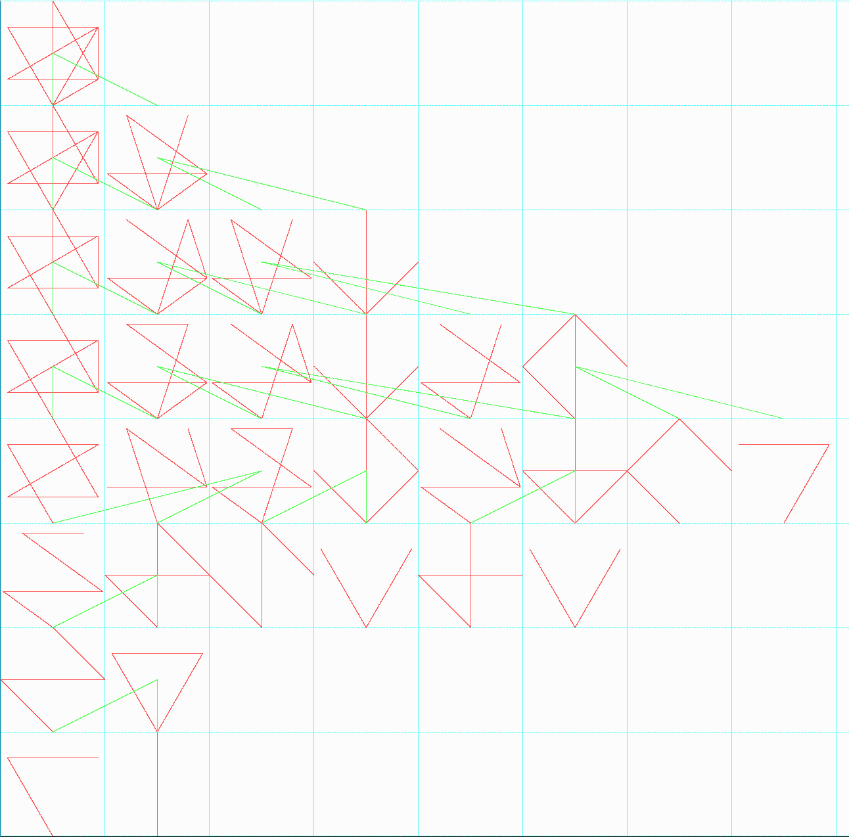

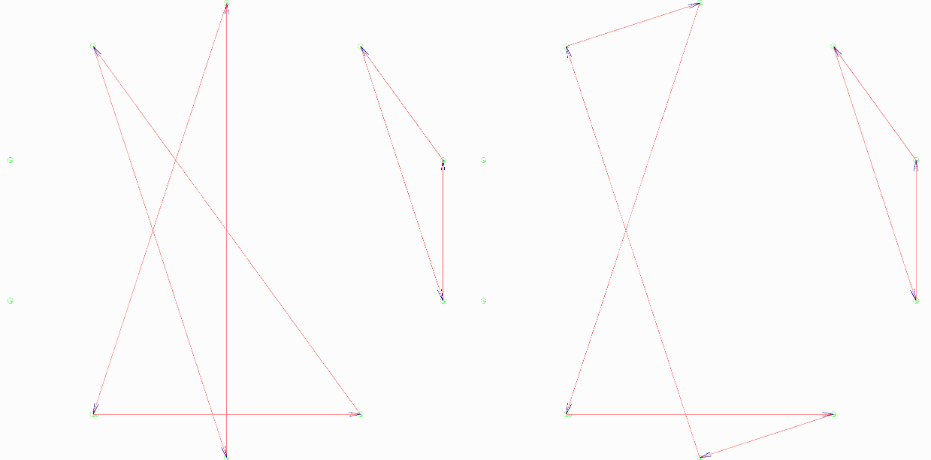

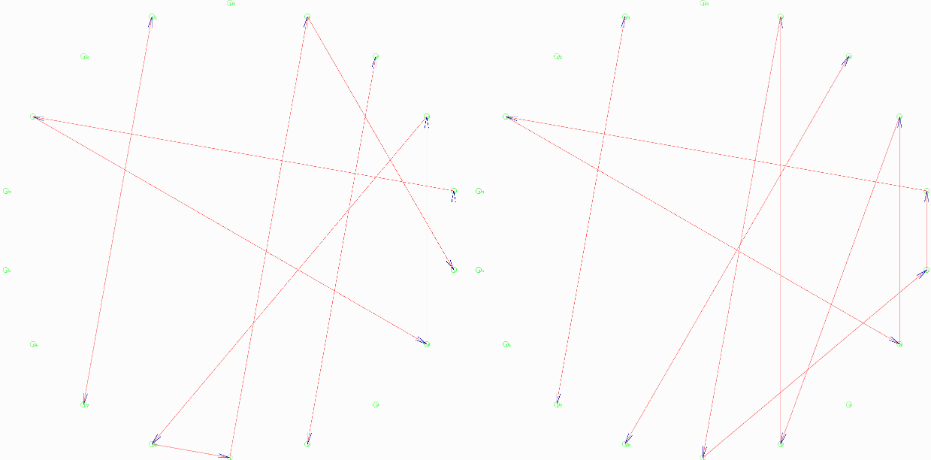

1.2 Spektral Layout

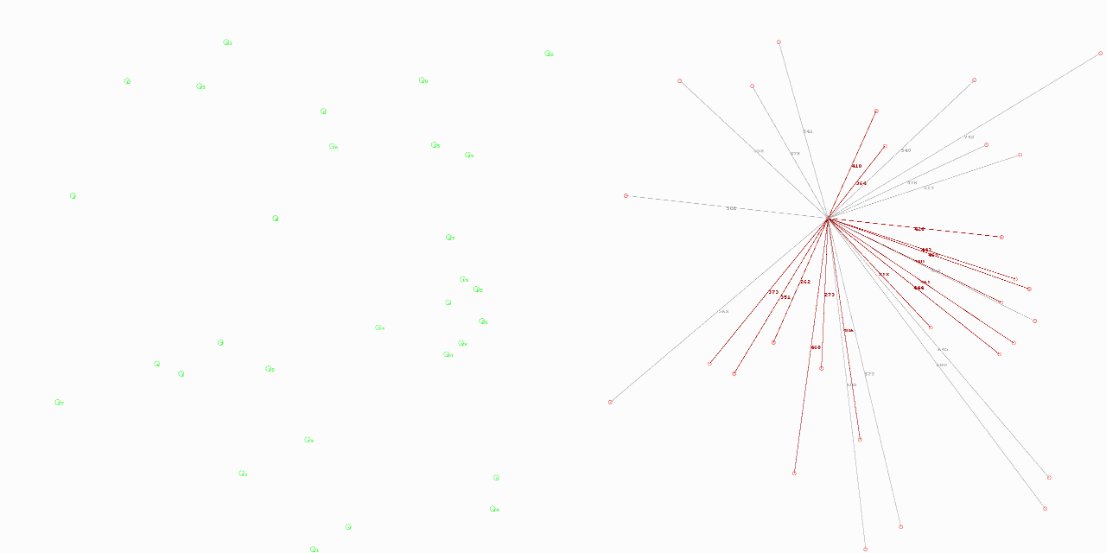

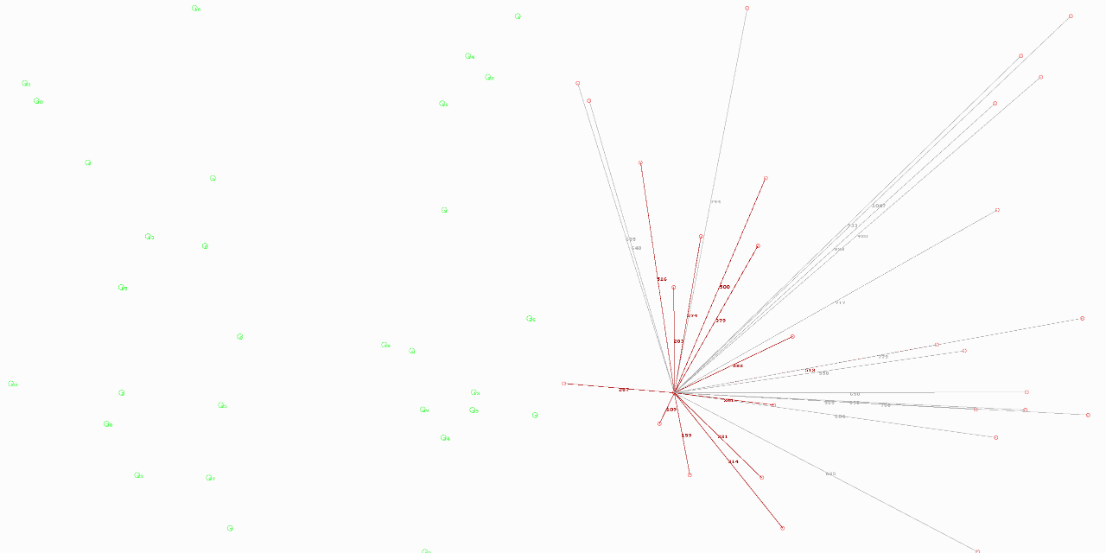

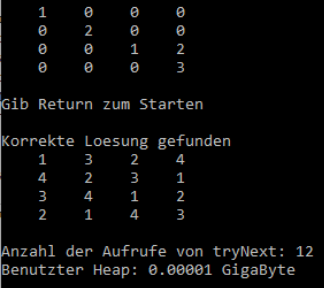

Der hier gezeigte Algorithmus basiert auf den Eigenvektoren der Adjazenzmatriz bzw. Laplace-Matrix; er wird von Y. Koren in [17] vorgestellt. Ich habe ihn, abgesehen von der relativ einfachen Realisierung, vor allem deshalb ausgesucht, weil er ohne zusätzlichen Aufwand auch dreidimensionale Graphen erstellen kann.

Die Grundidee besteht darin, bestimmte Eigenvektoren der Adjazenz- oder Laplace-Matrix als Koordinaten für das Zeichnen der Knoten zu verwenden. Genauer, man nimmt für eine 2-D-Zeichnung die beiden Eigenvektoren der Laplace-Matrix, die zu den beiden kleinsten Eigenwerten ungleich Null gehören (siehe Satz 1.25g) und verwendet die i-ten Komponenten als Koordinaten $(x_i, y_i)$ für den Knoten i. Für eine dreidimensionale Darstellung nimmt man einfach den nächsten Eigenvektor dazu. Dabei müssen die Eigenvektoren orthonormalisiert werden.

Entwickelt man mit diesen Angaben drauf los, stößt man schnell an Grenzen, einfach weil allein die Berechnung der Eigenvektoren einer großen Matrix sehr aufwändig ist ebenso wie ihre Orthonormalisierung, vor allem wenn man bedenkt, dass man nur 2 oder 3 davon benötigt.

Statt dessen berechnet der Algorithmus von Koren nur p-viele orthonormalisierte Eigenvektoren $u^2, \cdots, u^p$, wobei p sinnvollerweise 2 oder 3 ist. Ausgangspunkt ist hier die Matrix $D^{-1}A$, wobei D die Gradmatrix und A die Adjazenzmatrix ist. Von der zugehörigen Laplace-Matrix wissen wir (Satz 1.25g), dass $1_n$ Eigenvektor zum Eigenwert 0 ist. Es folgt:

$$

D^{-1}\cdot A \cdot 1_n \underset{1.25a}{=} D^{-1}(D - L) 1_n=(I-D^{-1}L)1_n = 1_n - D^{-1}L1_n = 1_n

$$

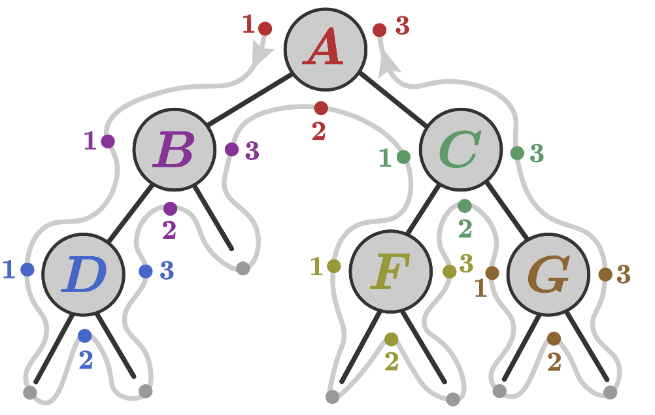

Also ist $1_n$ Eigenvektor von $D^{-1}A$ zum Eigenwert 1. Der Koren-Algorithmus berechnet nun nacheinander weitere Eigenvektoren $u^2, u^3, \cdots, u^p$ und sorgt dafür (Gram-Schmidt-Orthogonalisierung), dass die $u^k$ aufeinander senkrecht (im Sinne des Inneren Produktes $<u,Dv>$) stehen und auf 1 normiert sind. Die weiteren Eigenvektoren werden iterativ durch fortlaufende Multiplikation mit $\frac{1}{2}(I+D^{-1}A)$ erzeugt, was überdies bewirkt, dass sich die Eigenwerte im Intervall $[0,1]$ tummeln. Gestartet werden die Iterationen für jeden weiteren zu berechnenden Eigenvektor mit einem zufällig erzeugten Startvektor. Dieses "Power-Iteration" genannte Verfahren ist laut Koren konvergent.

Für jeden zu berechnenden Eigenvektor $u^k$:

Erzeuge zufällligen Startvektor

Normiere Startvektor

Wiederhole

D-Orthogonalisiere Startvektor mit allen anderen schon vorhandenen Eigenvektoren, erhalte $u^k$

Multipliziere den Ergebnisvektor $u^k$ mit $\frac{1}{2}(I+D^{-1}A)$, erhalte $\tilde{u}^k$

Normiere diesen Vektor $\tilde{u}^k$

bis $\tilde{u}^k$ parallel zu $u^k$.

Speichere $\tilde{u}^k$ als neuen Eigenvektor ab.

Ich habe den exakten Algorithmus in Maple programmiert, da Maple eine sehr leistungsfähige graphische Unterstützung bietet.

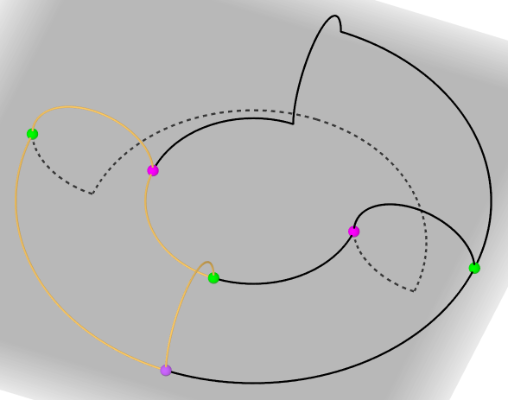

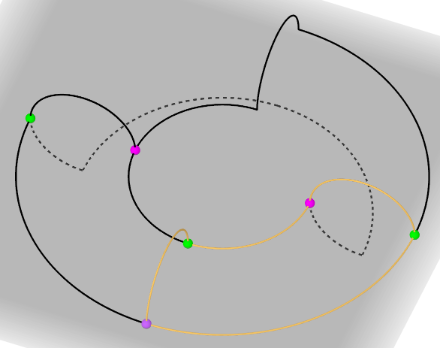

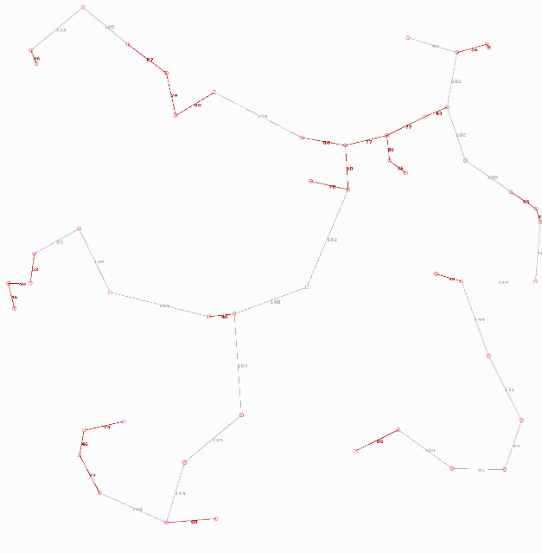

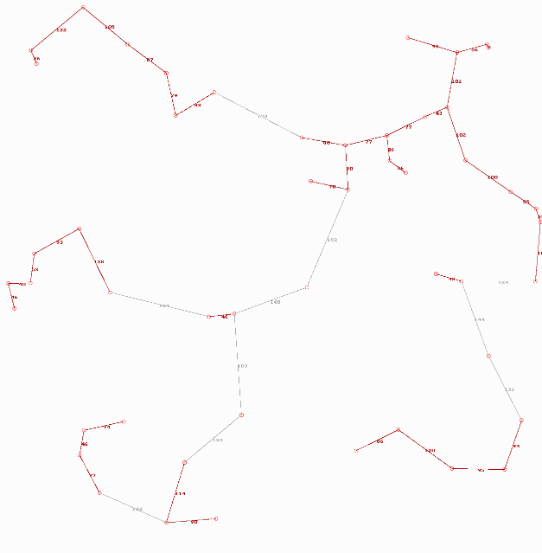

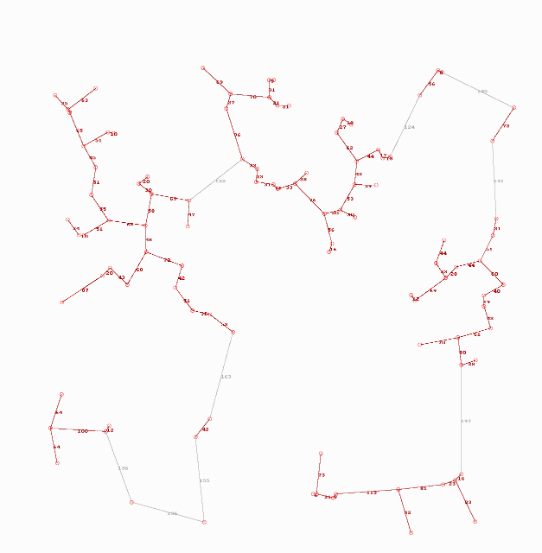

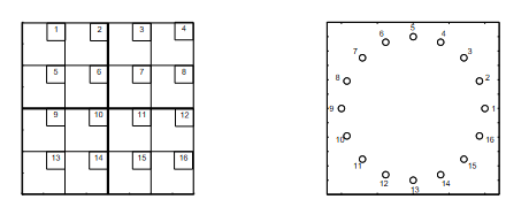

Als erste Adjazenzmatrix habe ich die des Graphen über Definition 1.19 verwendet.

Die zweite Matrix ist durch Vervierfachung der ersten entstanden: $7 \times 7 \rightarrow 14 \times 14$. Dadurch erklärt sich die Ähnlichkeit der beiden zweidimensionalen Graphen.

Als drittes Beispiel habe ich einen Graph mit 30 Knoten zeichnen lassen. Die Beispiele im Aufsatz von Koren zeigen mehrerer 100 Knoten.

Das Aussehen der Graphen hängt im Übrigen von dem zufälligen Startvektor ab.

1.3 Der Zufallswanderer

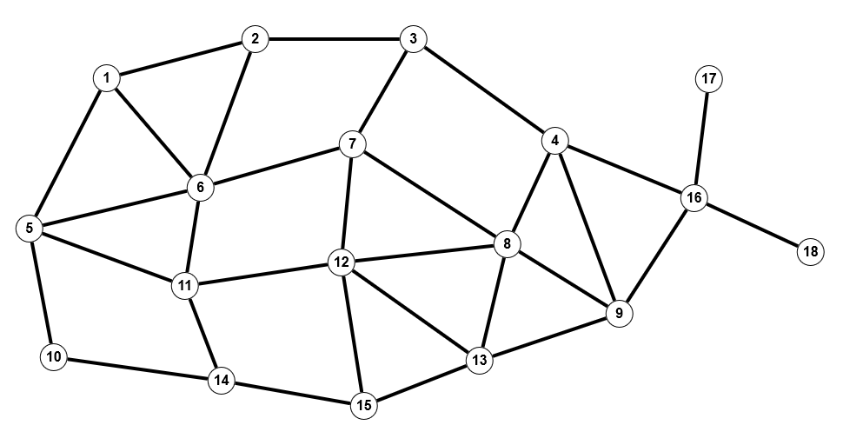

Fragestellung: Wie groß ist die Wahrscheinlichkeit, dass der Wanderer zuerst an dem Ausgangsknoten vorbeikommt, bevor er den Knoten mit der Falle erreicht?

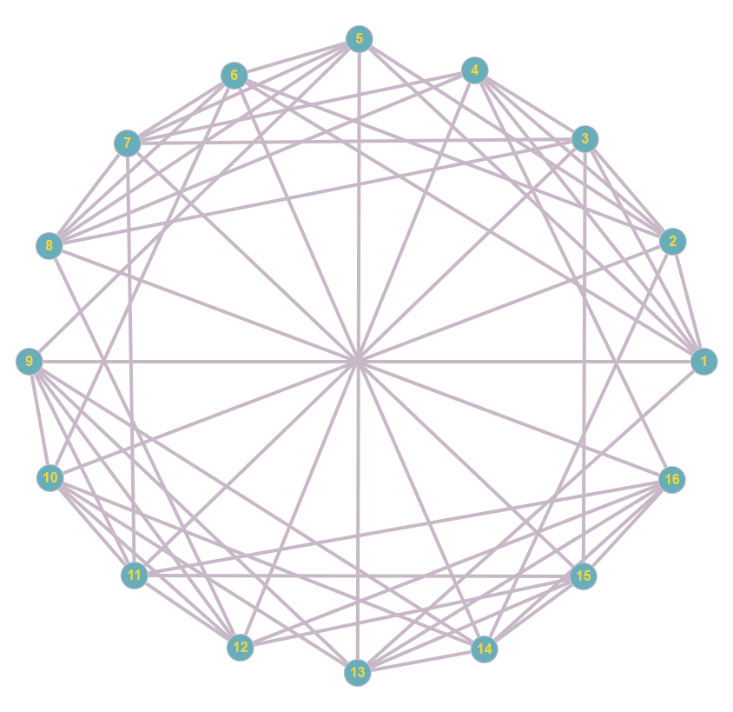

Schauen wir uns mal ein Beispiel an:

Nehmen wir weiter an, dass der Knoten 10 der Ausgang ist, der Knoten 12 die Falle und der Knoten 2 der Startknoten des Wanderers. Bezeichne $x(i) \in V$ den Aufenthaltsort des Wanderers im i-ten Schritt, also $x(0) = v_2$. Und um wahrscheinlichkeitstheoretisch korrekt argumentieren zu können, nennen wir Z das Ereignis, dass der Wanderer zuerst in $v_a$ und dann erst in $v_f$ ankommt (was er natürlich nicht mehr tut, wenn er den Ausgang gefunden hat). Klar ist, dass zwei Wahrscheinlichkeiten von vorne herein feststehen, nämlich die Fälle $v_w=v_a$ oder $v_w=v_f$. Es gilt:

$$P(Z|x(0) = v_a) = 1$$

$$P(Z|x(0) = v_f) = 0$$

Wir suchen nun die Wahrscheinlichkeit $p_w = P(Z|x(0)=v_w)$, gemäß oben angenommenen Beispiel also $p_2=P(Z|x(0)=v_2)$.

Mit Hilfe der Wahrscheinlichkeitsrechung formen wir um:

$$p_2=P(Z|x(0)=v_2)=P(Z \wedge x(1) = v_1) \vee P(Z \wedge x(1) = v_3) \vee P(Z \wedge x(1) = v_6)$$

Sind zwei Wahrscheinlichsereignisse mit "oder" verbunden, dann addieren sich die Wahrscheinlichkeitswerte:

$$p_2=P(Z|x(0)=v_2)=P(Z \wedge x(1) = v_1) + P(Z \wedge x(1) = v_3) + P(Z \wedge x(1) = v_6)$$

Ebenso lässt sich unter Verwendung bedingter Wahrscheinlichkeiten weiter umformen:

$$p_2=P(Z|x(1)=v_1) \cdot P(x(1)=v_1) + P(Z|x(1)=v_3) \cdot P(x(1)=v_3) + P(Z|x(1)=v_6) \cdot P(x(1)=v_6) =$$

$$\frac{1}{3}p_1 + \frac{1}{3}p_3 + \frac{1}{3}p_6 = \frac{1}{3}(p_1 + p_3 +p_6)$$

Es zeigt sich, dass sich die Startwahrscheinlichkeit $p_2$ aus den Startwahrscheinlichkeiten an den benachbarten Konten und der Wahrscheinlichkeit mit der eine Kante ausgewählt wird zusammensetzt. Dies lässt sich leicht verallgemeinern (es bezeichne $N_i$ die Knotennummern der zu $v_i$ benachbarten Knoten):

$$ p_i=P(Z|x(0)=v_i)=\sum_{j \in N_i} P(Z \wedge x(1) = v_j)=\frac{1}{d_G(v_i)}\sum_{j \in N_i} p_j \quad (*) $$

Diese Gleichungen gelten für alle $i \in \{1, \cdots, n(G)\} \setminus \{a,f\}$.

Zunächst kann man diese Gleichungen etwas kompakter schreiben. Zu diesem Zweck definiere ich eine Matrix A, die Adjazenzmatrix.

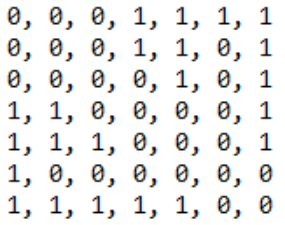

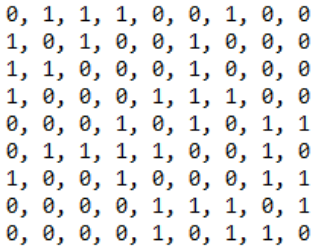

Die Adjazenzmatrix zu obigem Graphen hat folgendes Aussehen, wobei die Kommata zur besseren Lesbarkeit eingefügt wurden:

0, 1, 0, 0, 1, 1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0

1, 0, 1, 0, 0, 1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0

0, 1, 0, 1, 0, 0, 1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0

0, 0, 1, 0, 0, 0, 0, 1, 1, 0, 0, 0, 0, 0, 0, 1, 0, 0

1, 0, 0, 0, 0, 1, 0, 0, 0, 1, 1, 0, 0, 0, 0, 0, 0, 0

1, 1, 0, 0, 1, 0, 1, 0, 0, 0, 1, 0, 0, 0, 0, 0, 0, 0

0, 0, 1, 0, 0, 1, 0, 1, 0, 0, 0, 1, 0, 0, 0, 0, 0, 0

0, 0, 0, 1, 0, 0, 1, 0, 1, 0, 0, 1, 1, 0, 0, 0, 0, 0

A = 0, 0, 0, 1, 0, 0, 0, 1, 0, 0, 0, 0, 1, 0, 0, 1, 0, 0

0, 0, 0, 0, 1, 0, 0, 0, 0, 0, 0, 0, 0, 1, 0, 0, 0, 0

0, 0, 0, 0, 1, 1, 0, 0, 0, 0, 0, 1, 0, 1, 0, 0, 0, 0

0, 0, 0, 0, 0, 0, 1, 1, 0, 0, 1, 0, 1, 0, 1, 0, 0, 0

0, 0, 0, 0, 0, 0, 0, 1, 1, 0, 0, 1, 0, 0, 1, 0, 0, 0

0, 0, 0, 0, 0, 0, 0, 0, 0, 1, 1, 0, 0, 0, 1, 0, 0, 0

0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 1, 1, 1, 0, 0, 0, 0

0, 0, 0, 1, 0, 0, 0, 0, 1, 0, 0, 0, 0, 0, 0, 0, 1, 1

0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 1, 0, 0

0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 1, 0, 0

Netterweise kann man das Gleichungssystem (*) mit Hilfe dieser Matrix schreiben, denn die $p_i$ kommen mit dem Faktor 1 oder 0 vor und entsprechen genau dem Nachbarschaftsverhältnis. Dabei ignorieren wir zunächst die Tatsache, dass es einen Ausgangsknoten und einen Fallenknoten gibt. Dazu bringen wir die Knotengrade auf die linke Seite und fassen Sie zu einer Diagonalmatrix $D$ zusammen: $d_{i,i}=grad(v_i)$. Schließlich bezeichne $p:=(p_1, p_2, p_3, ..., p_{N(G)})$ den aus den Wahrscheinlichkeiten zusammengesetzten Vektor und wir erhalten:

$$ D\cdot p = A \cdot p$$

Und wenn man will, geht das noch etwas kompakter mit der Laplace-Matrix $L:= D - A$ als $L \cdot p = 0$. Dies sieht wie ein homogenes lineares Gleichungssystem aus, ist es aber nicht, wenn man sich in Erinnerung ruft, dass zwei Werte von $p$ ja festliegen. Um die unbekannten Werte von $p$ zu berechnen, formt man weiter um. Als rechte Seite eines inhomogenen Gleichungssystems $r$ wählt man die negative Spalte mit der Nummer $a$ der Matrix $L$, wobei man die Werte mit dem Index $a$ und $f$ weg lässt. Somit ist $r$ ein Vektor der Dimension $n(G) -2$. Ist ja klar, denn wir wollen ja auch nur $n(G)-2$ Werte von $p$ berechnen. Wenn man jetzt noch die Matrix $C$ durch Weglassen der Zeilen und der Spalten mit den Nummern $a$ und $f$ aus der Matrix $L$ erzeugt, ist das zu lösende Gleichungssystem

$$C\cdot \tilde{p} = r$$.

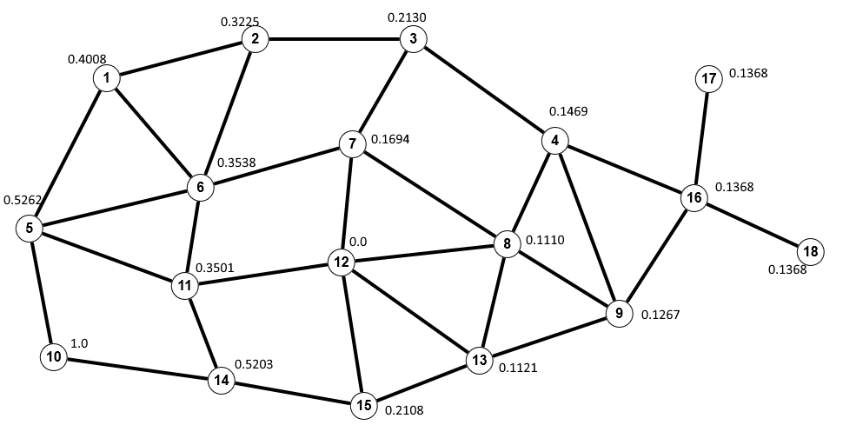

Dieses Gleichungssystems ist lösbar, da $C$ maximalen Rang hat (also regulär ist). Der Lösungsvektor $\tilde{p}$ enthält alle Wahrscheinlichkeiten für Startpunkte ungleich $v_a$ und $v_f$; durch Einfügen von 1 und 0 an den besagten Stellen ergibt sich:

.400851169457537

.322543492572121

.21295683528478

.146873382142279

.526187542826443

.353822472974046

.16945363113994

.111035216300932

p = .126709857274843

1.0

.35007652887419

0.

.1121392109476

.520296099696271

.210811770214624

.136791619708561

.136791619708561

.136791619708561

Somit $v_5$ der "beste" Startpunkt, also mit der höchsten Wahrscheinlichkeit den Ausgang vor der Falle zu finden, direkt gefolgt von $v_{14}$, was nicht wundert.

Legt man, um noch ein weiteres Beispiel zu zeigen, den Ausgang in den Knoten 17 und die Falle nach 18 (oder umgekehrt), errechnet sich für jeden Startknoten (natürlich außer 17 und 18) die Wahrscheinlichkeit von $\frac{1}{2}$, was leicht einzusehen ist, denn die Entscheidung, ob man den Ausgang findet oder in die Falle geht, entscheidet sich erst und genau im Knoten 16, und da ist sie eben $\frac{1}{2}$. Und tatsächlich wird auch das Anlegen einer Sperre richtig berechnet, d.h. für die Falle in Knoten 16 und den Ausgang in 17 (oder 18) werden alle Wahrscheinlichkeiten (außer 17) zu 0.0 berechnet.

In der Anlage ZWProc.mw findet sich eine in Maple geschriebene Prozedur, die die Berechnung der Wahrscheinlichkeiten vornimmt. Die Adjazenzmatrix wird aus einer txt.Datei eingelesen (Elemente wie in obigem Beispiel $A$ angeordnet).

ZWProc.mw

In [3] stellt Hochfilzer einen Zusammenhang des Zufallswanderers mit dem Verhalten von Gleichstromkreisen her. Im nächsten Kapitel werde ich dieses Thema aufgreifen, aber allgemein behandeln.

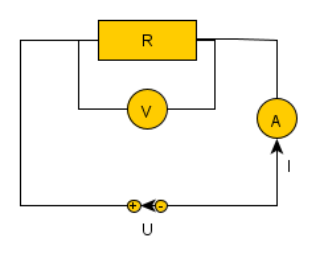

1.4 Gleichstromkreise als Graphen

Im einfachsten Fall sieht ein solcher Stromkreis so aus:

Es gilt das Ohmsche Gesetz $R=\frac{U}{I}$. Strom fließt, deshalb hat er eine Richtung, per Definition von + nach - (technische Stromrichtung), tatsächlich fließen die Elektronen von - nach + (physkalische Stromrichutung); ein Strommessgerät wird deshalb in den Stromkreis an der Stelle integriert, an der man die Stromstärke messen will (es sollte einen möglichst kleinen Innenwiderstand haben). Je nachdem in welcher Richtung man das Gerät polt, zeigt es einen positiven oder negativen Strom an.

Spannung herrscht zwischen zwei Punkten, man sagt, sie fällt an einem Widerstand ab. Zum Messen wird das Spannungsmessgerät an den Punkten angeschlossen, zwischen denen man die Spannung messen will, also nicht in den Stromkreis integriert (Das Spannungsmessgerät sollte einen möglichst hohen Innenwiderstand haben).

Rechenbeispiel:

$U=5 [V], R = 10 [\Omega].$ Wie groß ist die Stromstärke? Antwort: $I=\frac{U}{R} [\frac{V}{\Omega}] = 0.5 [A].$

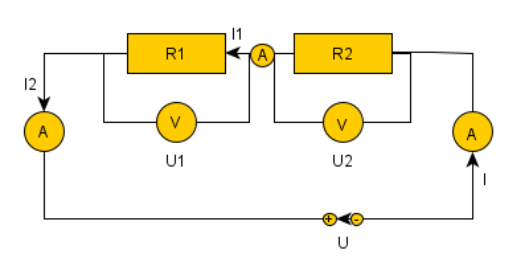

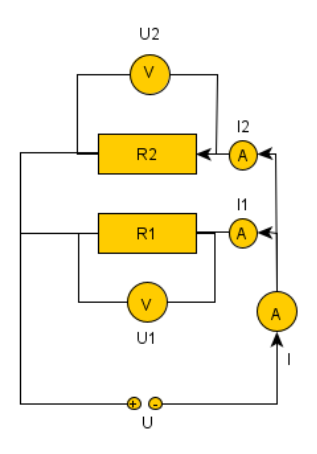

Mit den vorhandenen Bauelementen kann man den Kreis erweitern. Das erste Bild zeigt eine Reihenschaltung zweier Widerstände, das zweite Bild eine Parallelschaltung.

Für die Reihenschaltung gilt, dass sich die Widerstände und die Spannungen, die an den Widerständen abfallen (=von den Messgeräten angezeigt werden) addieren, die Stromstärke ändert sich nicht.

$$ R = R_1 + R_2 \quad U = U_1 + U_2 \quad I = I_1 = I_2$$

Rechenbeispiel:

$U=5 [V], R_1 = 4 [\Omega], R_2 = 6 [\Omega].$ Wie groß ist die Stromstärke und wie groß sind die Spannungsabfälle an den beiden Widerständen? Antwort: $R=R_1 + R_2 = 10 [\Omega], \; I = I_1 =I_2 = \frac{U}{R} [\frac{V}{\Omega}] = 0.5 [A], \; U_1 = R_1 \cdot I_1 [\Omega \cdot A] =2 [V], \; U_2 = R_2 \cdot I_2 [\Omega \cdot A] =3 [V]$ oder auch $ U2 = U - U1 = 3 [V].$

Für die Parallelschaltung gilt, dass sich die Leitfähigkeiten (das ist der Kehrwert des Widerstandes) und die Stromstärken addieren, die Spannung(-sabfall) ist an jedem Widerstand gleich.

$$ \frac{1}{R}= \frac{1}{R_1} + \frac{1}{r_2} \quad I = I_1 + I_2 \quad U = U_1 = U_2$$

Rechenbeispiel:

$U = 5 [V], R_1 = 4 [\Omega], R_2 = 6 [\Omega].$ Wie groß sind die Stromstärken und wie groß ist der Gesamtwiderstand? Antwort: $ \frac{1}{R}= \frac{1}{R_1} + \frac{1}{R_2} = \frac{1}{4} + \frac{1}{6}= \frac{5}{12} \Rightarrow R = 2.4 [\Omega], \; I_1 = \frac{U}{R_1} = \frac{5}{4} [\frac{V}{\Omega}] = 1.25 [A], \; I_2 = \frac{U}{R_2} = \frac{5}{6} [\frac{V}{\Omega}] = 0.83 [A], \; I = I_1 + I_2 = \frac{5}{4} + \frac{5}{6}=2.083 [A].$ Oder auch: $ I = \frac{U}{R} = \frac{5}{\frac{12}{5}}=2.083 [A].$

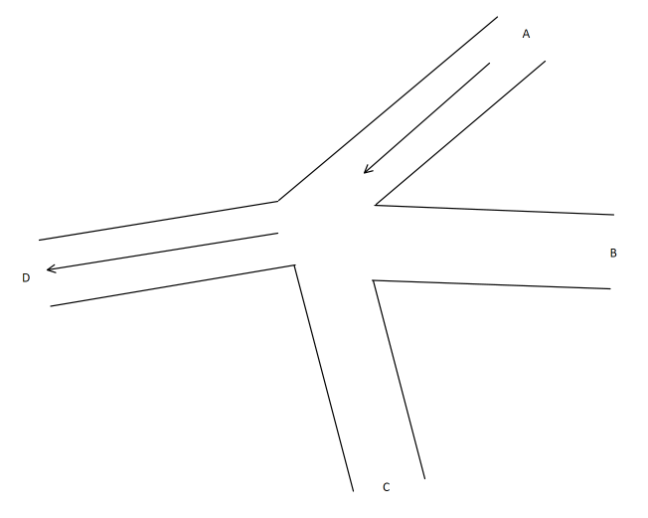

Soweit die kleine Wiederholung der Grundlagen des einfachen Gleichstromkreises. In vielen technischen Anwendungen ist der Aufbau eines Gleichstromkreises aber ungleich komplizierter. Dazu folgendes Beispiel [5] ohne direkten Anwendungsbezug.

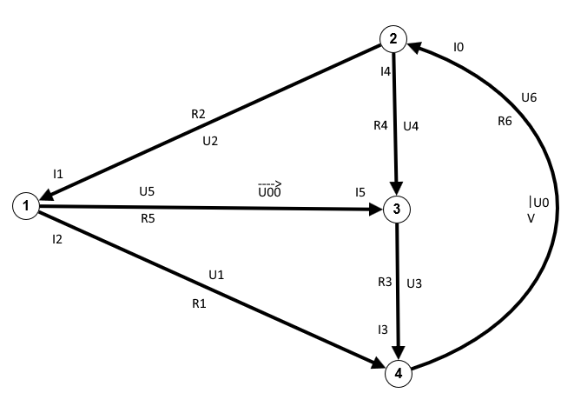

Für solche komplexeren Stromkreise gibt es die beiden Kirchhoffschen Gesetze, auch Knotenregel und Maschenregel genannt - langsam nähern wir uns wieder der Graphentheorie. Knoten sind in obiger Skizze rot eingezeichnet.

Die Knotenregel sagt etwas aus über die Ströme, die an einem Knoten zusammen-/ auseinanderfließen. Betrachten wir in obiger Skizze den Knoten 1; dort "treffen" sich die Ströme $I_1, \; I_2, \; I_6$. Diese Ströme haben alle eine Richtung, die bei der Zeichnung letztlich willkürlich gewählt wurde. Kommt bei der Berechnung ein negativer Wert heraus, so bedeutet dies, dass die Stromrichtung entgegen der eingezeichneten läuft. Die Knotenregelung lautet nun :

$$ \sum_{n=1}^N I_n = 0,$$

was bedeutet, dass sich die (vorzeichenbehafteten) Ströme, die sich in einem Knoten treffen, zu Null aufaddieren. Man muss nur darauf achten, dass man den Strömen bei Aufstellung der Gleichung die richtigen Vorzeichen gibt; ein Strom, der in der Zeichnung in den Knoten hineinfließt bekommt das entgegengesetzte Vorzeichen zu einem Strom, der aus dem Knoten herausfließt. Für Knoten 1 gilt also:

$$I_1 -I_2-I_6=0.$$

Genauso richtig wäre $-I_1 + I_2 + I_6=0$, denn man kann ja eine Gleichung auf beiden Seiten mit der gleichen Zahl (-1) malnehmen.

In gleicher Weise folgt für die Knoten 2 und 3:

$$ I_3 - I_4 - I_7=0 \text{ und } I_4 + I_6 + I_7 - I_5 = 0.$$

Die beiden von mir eingezeichneten Knoten 4 und 5 sind überflüssig, da an ihnen keine Verzweigung der Ströme stattfindet, es gilt insbesondere $I_2 = I_3$.

Die Maschenregel benötigt zu ihrer Formulierung zunächst einmal den Begriff der Masche. An dieser Stelle ist es spätestens sinnvoll, obigen Stromkreis als Graph im Sinne der Graphentheorie zu zeichnen. Unter Weglassung der überflüssigen Knoten 4 und 5 erhält man:

Die Richtung der Kanten zeigt die (angenommene) Richtung der Spannung (Spannungspfeil) an. Üblicherweise zeigen Strom und Spannung in die gleiche Richtung.

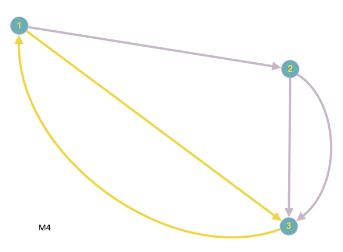

Eine Masche ist nun einfach ein Untergraph, der ein Kreis-Graph ist, wenn man den Graphen als ungerichtet betrachtet. Obiger Graph hat somit folgende Maschen:

Eine Masche bekommt eine Umlaufrichtung (Maschenpfeil), wobei es egal ist, welche man wählt. Diese Umlaufrichtung dient nun dazu, den Spannungen ein Vorzeichen zu geben. Wenn der Maschenpfeil und der Spannungspfeil die gleiche Richtung haben, wird die Spannung positiv, sonst negativ gesetzt. Die Maschenregel lautet nun:

$$\sum_{n=1}^N U_n = 0.$$

Für die Masche $M_1$ nehmen wir an, dass der Maschenpfeil die Richtung von Knoten 1 nach 2 hat. Dann haben alle Spannungen dieser Masche ein positives Vorzeichen mit Ausnahme von $U_0$, also gilt: $U_1 + U_2 + U_3 + U_7 + U_5 - U_0 = 0$.

Für die Masche $M_2$ nehmen wir an, dass der Maschenpfeil die Richtung 1 nach 2 hat. Dann haben alle Spannungen dieser Masche ein positives Vorzeichen mit Ausnahme von $U_6$, also gilt: $U_2 + U_3 + U_4 - U_6 = 0$.

Für die Masche $M_3$ nehmen wir an, dass der Maschenpfeil die Richtung von Knoten 2 nach 3 hat. Dann gilt: $U_7 - U_4 = 0$.

Entsprechendes kann man für die weiteren Maschen herleiten.

Jetzt haben wir einen Wust von Gleichungen, aber es fehlt schon noch der rote Faden zur Berechnung von Spannungen und Strömen in einem Gleichstromkreis. Insbesondere muss man sich beim Aufstellen der Gleichungen darum kümmern, welche Gleichung linear unabhängig sind und von der Sorte müssen es auch genug sein, damit man das Gleichungssystem lösen kann. Da gibt es gleich 3 Möglichkeiten, die man verwenden kann:

- das Zweigstromverfahren

- das Maschenstromverfahren [4]

- das Knotenpunktpotentialverfahren

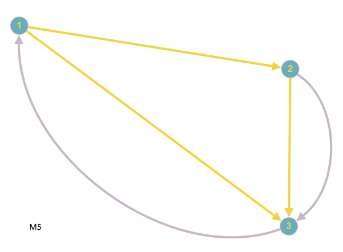

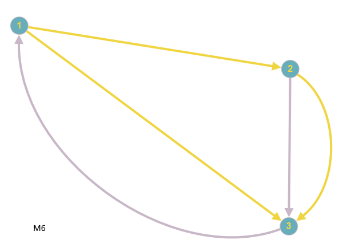

Da es mir hier nicht um eine physikalische Vorlesung zur Elektrik geht, greife ich hier nur ein Verfahren heraus, nämlich das Maschenstromverfahren, da es einen weiteren Aspekt der Graphentheorie verwendet. Auch werde ich die Darstellung soweit vereinfachen wie möglich, um das Wesentliche auf das es mir ankommt, herausarbeiten zu können. Den Stromkreis stelle ich wieder als gerichteten Graphen dar, wobei, wie oben, die Richtungen der Kanten den Strom- und Spannungsrichtungen entsprechen. Der Stromkreis hat zwei Spannungsquellen $U_{00}$ und $U_0$, wobei $U_{00}$ so gepolt ist, dass ihr Spannungspfeil in Richtung von $I_5$ zeigt, $U_0$ so, dass ihr Spannungspfeil entgegen der Richtung von $I_0$ liegt.

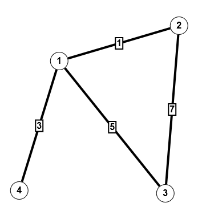

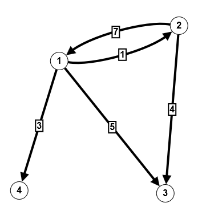

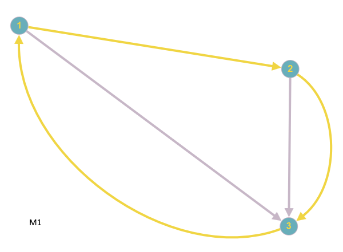

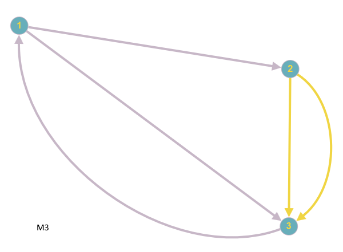

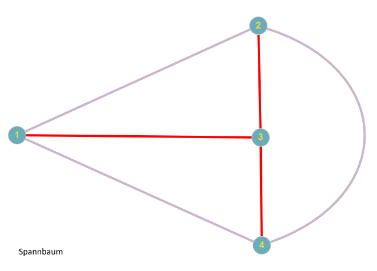

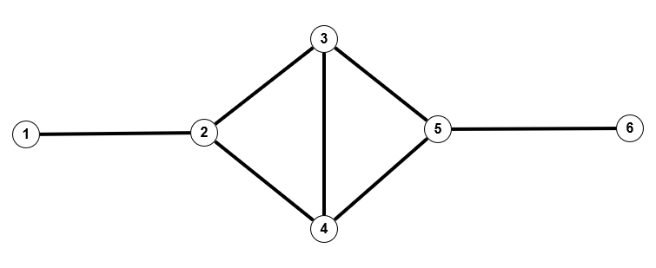

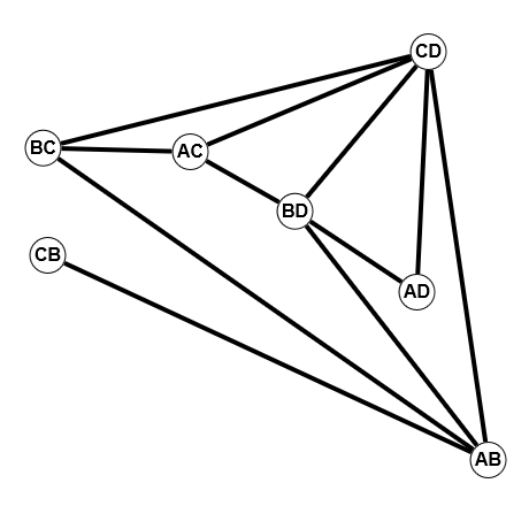

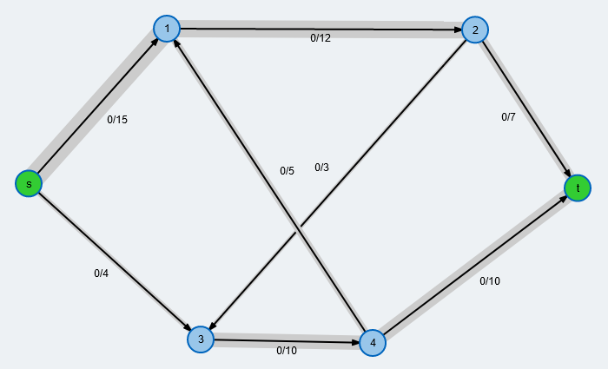

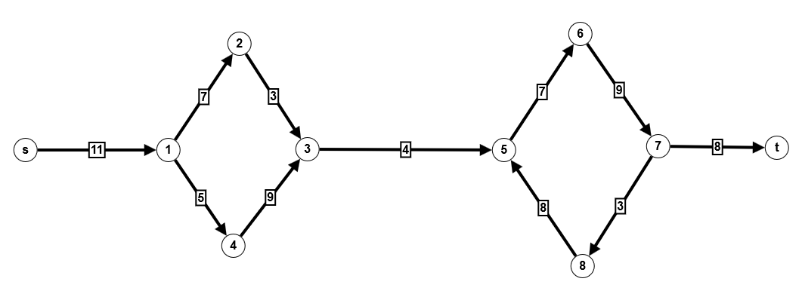

Ähnlich wie bei der Maschenregel muss man als erstes Maschen definieren, in denen dann (gedachte) Maschenströme fließen, die zu Maschengleichungen führen. Die Grundregel bei der Bildung von Maschen lautet, dass jede Kante des Gleichstromgraphen zu mindestens einer Masche angehören muss. Diese Maschengleichungen müssen dann sinnvollerweise linear unabhängig sein, damit man das Gleichungssystem lösen kann. Und jetzt kommt's: Die Wahl der Maschen wird durch die Graphentheorie unterstützt; man bestimmt einen Spannbaum in dem gegebenen (ungerichteten) Graphen. Dies ist ein Untergraph eines zusammenhängenden Graphen, der jeden Knoten im Graphen einmal trifft, also keine Kreise enthält (siehe Kapitel über Bäume). Ein solcher Spannbaum unterteilt dann den Gleichstromgraphen in Maschen, deren Maschengleichungen jedenfalls dann linear unabhängig sind, sofern zu jeder gebildeten Masche genau eine Verbindungskante gehört! Verbindungskante, das ist eine Kante des Graphen, die nicht zum Spannbaum gehört. Diese Bedingung ist allerdings nur eine notwendige Bedingung, d.h. es gibt sehr wohl Systeme von linear unabhängigen Maschengleichungen, bei denen Maschen mehrere Verbindungskanten enthalten, ja, man kann Graphen konstruieren, die keinen Spannbaum enthalten, der obige Einzigkeitsforderung erfüllt. [7]

Ein paar Zahlen können bei der Überprüfung der Wahl des Spannbaumes und der Maschen helfen. Sei $k=|V|$ die Anzahl der Knoten des (ungerichteten) Graphen und $z=|E|$ die Anzahl der Kanten. Dann ist $k-1$ die Anzahl der Kanten des (jedes) Spannbaumes und $z - (k-1)$ die Anzahl unabhängiger Maschengleichungen, die aufgestellt werden können. [6]

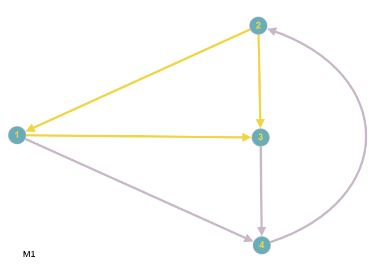

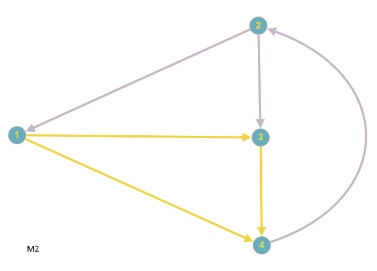

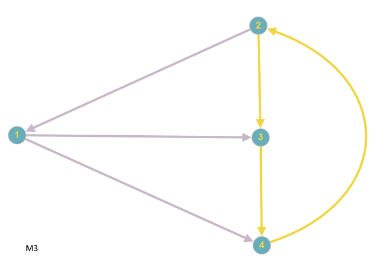

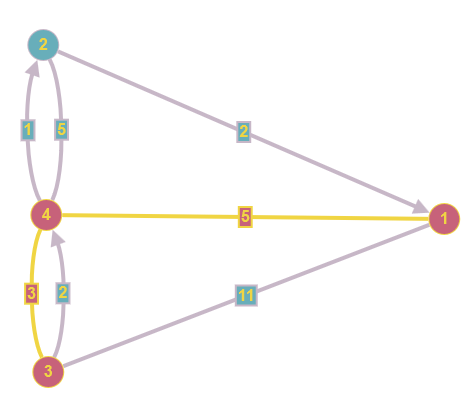

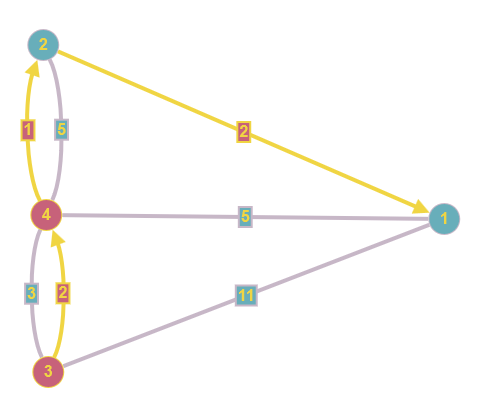

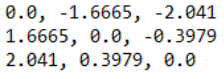

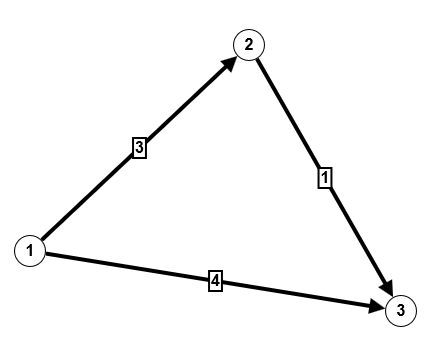

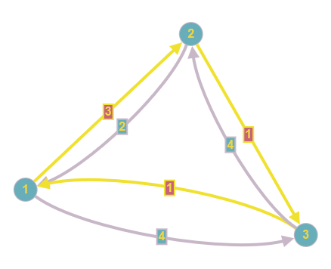

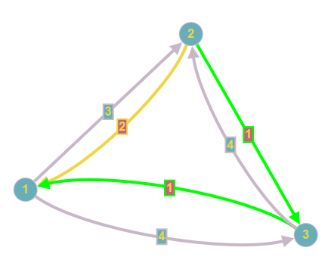

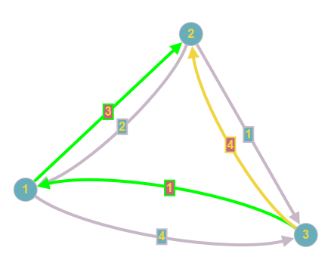

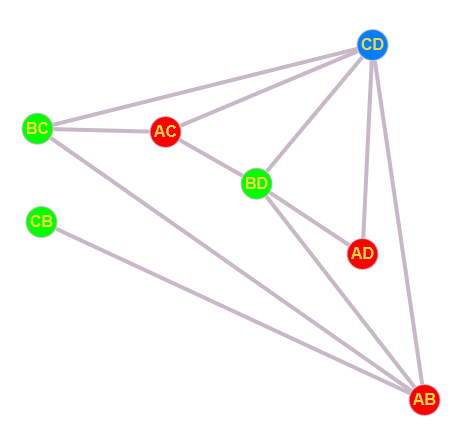

Elektrotechnisch ist es egal, welchen Spannbaum man nimmt, wenn er nur den obigen Regeln entspricht, also ein linear unabhängiges Gleichungssystem von Maschengleichungen erzeugt; in unserem Beispiel soll $S=\{\{1,3\}, \{2,3\}, \{3,4\}\}$ der Spannbaum sein. Die Verbindungskanten sind $\{1,2\}, \; \{1,4\}, \; \{2,4\}$. Folgende Bilder zeigen den Spannbaum (rote Kanten), sowie die daraus entstehenden Maschen. ($k=4, z=6 \Rightarrow $ 3 Kanten im Spannbaum, 3 l.u. Maschen, jede Kante gehört zu mindestens einer Masche, die Einzigkeitsregel für die Verbindungskanten ist erfüllt.)

Als (frei wählbare) Stromrichtung (Maschenpfeil) in den Maschen definieren wir: $M_1: \; 1 \rightarrow 2, \; M_2: \; 1 \rightarrow 4, \; M_3: \; 4 \rightarrow 2$ und betrachten den jeweils fließenden Maschenstromes $I_{M_i}$ gleichgerichtet.

Zum Aufstellen eines linearen Gleichungssystems definieren wir nun:

$R_{ii} := $ Summe aller Widerstände ausschließlich in Masche $M_i$.

$R_{ij} := $ Summe aller gemeinsamen Widerstände von Masche $M_i$ und $M_j$. Hierbei ist als Vorzeichenregel zu beachten, dass $R_{ij}$ ein positives Vorzeichen erhält, wenn die beteiligten Maschenströme in die gleiche Richtung zeigen, sonst ein Minuszeichen.

$Uq_{i} :=$ Summe aller Spannungsquellen in Masche $M_i$. Auch hier ist eine Vorzeichenregel zu beachten: Wenn Maschenpfeil und Spannungspfeil der Spannungsquelle entgegengesetzt sind, dann wird ein Plus gesetzt, sonst ein Minus.

Wir fassen zusammen:

$R:=(R_{i,j})$ ist eine (symmetrische) $m \times m$ - Matrix, wobei $m$ die Anzahl der gebildeten Maschen ist.

$IM:=(I_{M_i})^T$ ist ein Spaltenvektor aus $m$ Maschenströmen.

$Uq:=(Uq_{i})^T$ ist ein Spaltenvektor aus $m$ Spannungsquellensummen.

Das zu lösenden Gleichungssystem lautet nun:

$$R \cdot IM = Uq$$

Obiges Beispiel weiterverfolgend, schreibe ich nun die konkreten Werte für $R$ und $U_q$ hin:

$$

R =

\left(

\begin{array}{ccc}

R_2 + R_4 + R_4 & -R_5 & -R_4 \\

-R5 & R_1 + R_3 + R_5 & -R_3 \\

-R_4 & -R_3 & R_6 + R_3 + R_4\\

\end{array}

\right)

\quad

U_q =

\left(

\begin{array}{c}

U_{00}\\

-U_{00}\\

-U_0

\end{array}

\right)

$$

Es bleibt die gewünschten Ströme (und danach auch die Spannungen) aus den gefundenen Maschenströmen zu berechnen. Die Ströme $I_i$, deren Stromzweig nur zu einer Masche gehört, können direkt mit dem zugehörigen Maschenstrom ausgedrückt werden, wobei auch hier wieder gilt, dass bei unterschiedlicher Richtung ein Minuszeichen gesetzt werden muss. Im Beispiel sind die Richtungen aber gleich, also gilt:

$$ I_0 = IM_{M_3}, \; I_1 = IM_{M_2}, \; I_2 = IM_{M_1}$$

Die anderen drei Ströme setzen sich aus mehreren Maschen zusammen, sodass sie durch Addition bzw. Subtraktion der beteiligten Maschenströme berechnet werden müssen (Vorzeichenregel!):

$$ I_3 = IM_{M_3} - IM_{M_2}, \; I_4 = IM_{M_3} - IM_{M_1}, \; I_5 = IM_{M_1} - IM_{M_2}$$

Hurra geschafft!

Zwar ließen sich bei einem 3x3 - Gleichungssystem die Werte für die Ströme noch exakt berechnen, doch ist das Ergebnis länglich und eher uninteressant. Statt dessen gebe ich hier als konkretes Rechenbeispiel nur die Eingabewerte, also Widerstände und Spannungsquellen und die Ergebnisse für die Ströme an.

Rechenbeispiel:

Gegeben: $R1 = 10 [\Omega], \; R2= 5 [\Omega], \; R3 = 20 [\Omega], \; R4 = 15 [\Omega], \; R5 = 5 [\Omega], \; R6 = 10 [\Omega], \quad U_{00} = 10 [V], \; U_0 = 5 [V]$

Berechnet: $IM_{M_1}=I_2=\frac{27}{139} = 0,194 [A], \; IM_{M_2}=I_1= -\frac{53}{139}= -0,381 [A], \; IM_{M_3}=I_0=-\frac{30}{139}=-0,216 [A]$ und

$I_3 = \frac{23}{139}=0,165 [A], \; I_4=-\frac{57}{139}, \; I_5= \frac{80}{139}=0,576[A]$.

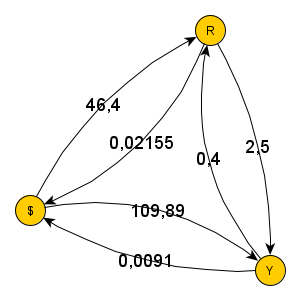

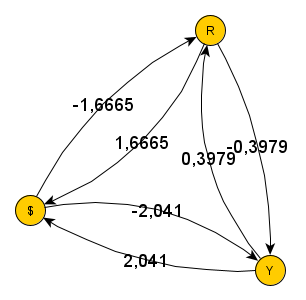

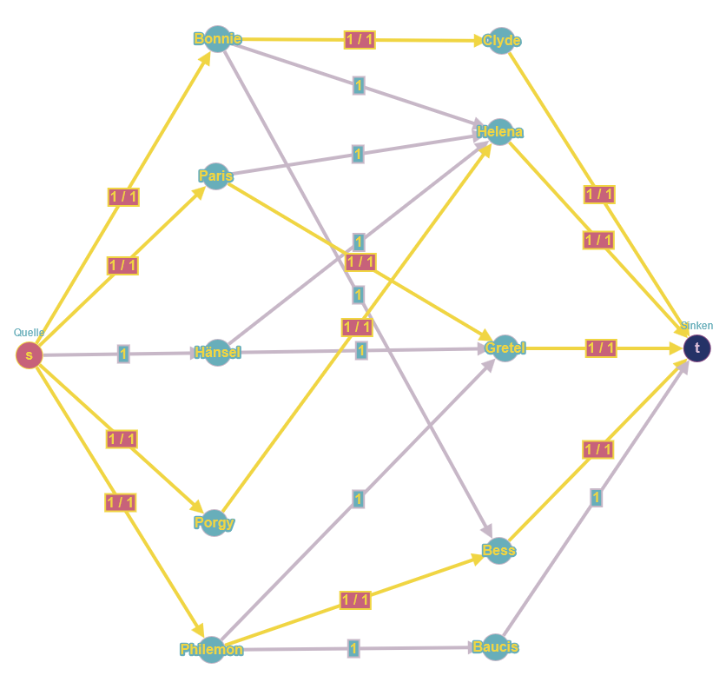

Wie im letzten Kapitel bereits angedeutet hat Hochfilzer in [3] einen Zusammenhang zwischen dem Zufallswanderer und Gleichstromkreisen beschrieben. Ich finde dieses Beispiel recht beeindruckend und will es hier auch kurz vorstellen. Insbesondere möchte ich die Berechnung des Gleichstromkreises mit dem gezeigten Maschenstromverfahren durchführen, um auch hier ein weiteres etwas umfangreicheres Beispiel zu haben.

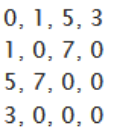

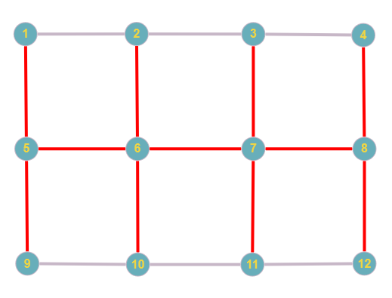

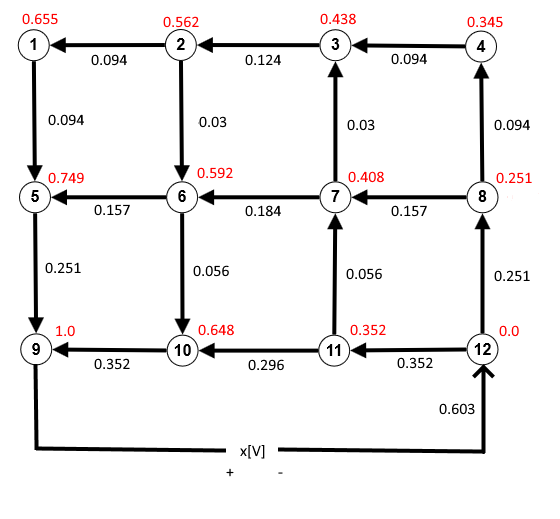

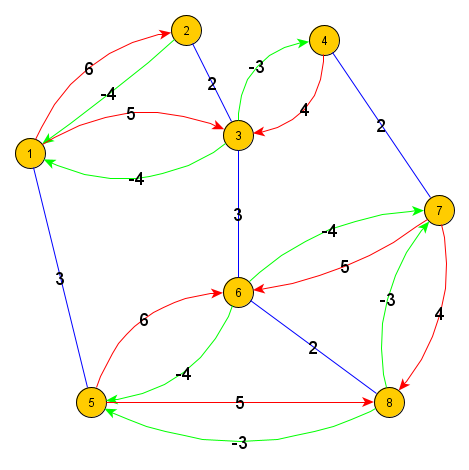

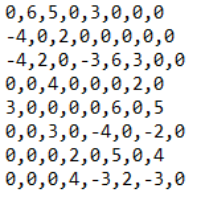

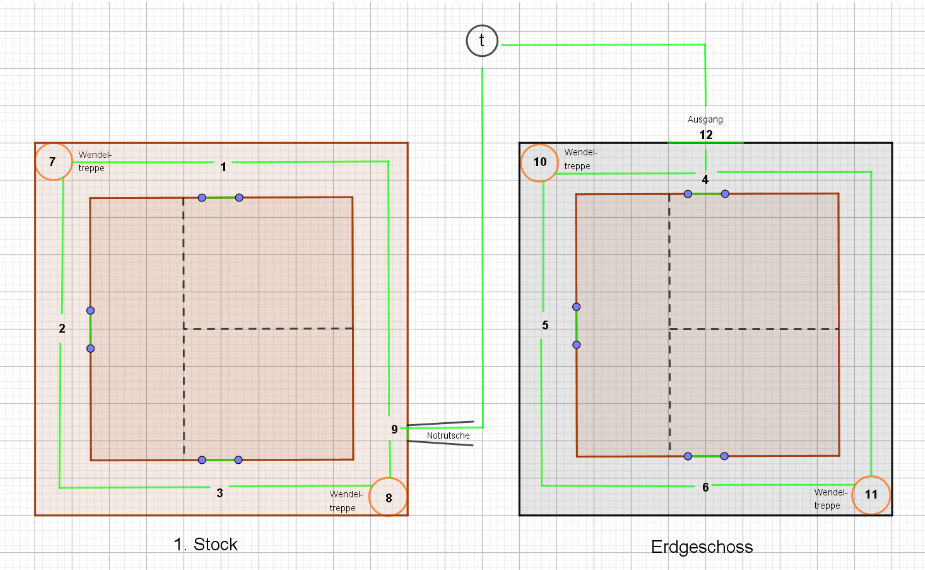

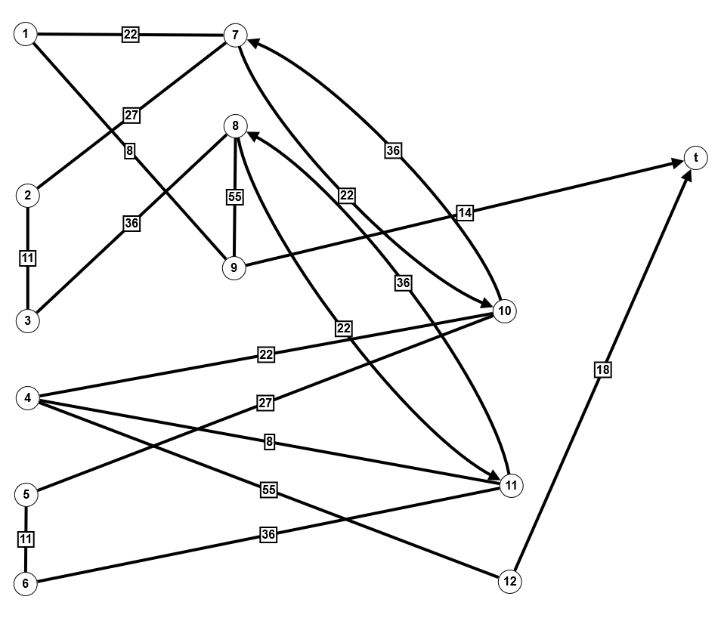

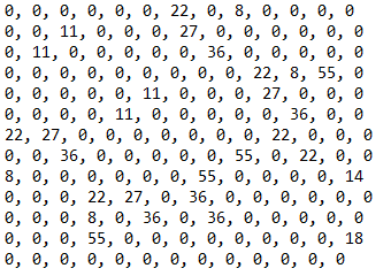

Wir beginnen mit dem Zufallswanderer und schicken ihn in folgenden Irrgarten, daneben die zugehörige Adjazenzmatrix:

![Zufallswanderer, Beispiel aus [3] ZWURIb](../../../_pics/875/ZWURIb.png)

Wie man sieht, ist der Ausgang im Knoten 9 und die Falle im Knoten 12. An den Knoten stehen bereits die Wahrscheinlichkeiten, den Ausgang vor der Falle zu finden, die ich mit ZWProc berechnet habe. Soweit so gut.

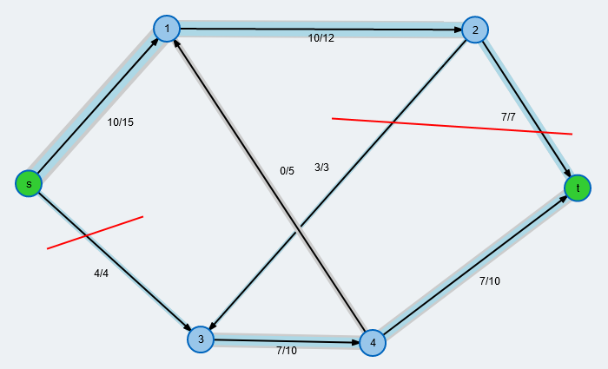

Als Gleichstromkreis verwenden wir den gleichen Graphen, erweitert um einen Zweig für eine Spannungsquelle, daneben der Spannbaum.

![Gleichstromkreis aus [3] ZWURId](../../../_pics/877/ZWURId.png)

Zwischen den Knoten, also auf den Kanten (außer zwischen 9 und 12) sollen Widerstände von jeweils $1 [\Omega]$ eingebaut sein, die Spannung $U_0$ betrage $x [V]$. Weiterhin stellen die gerichteten Kanten wie immer die Stromflüsse mit ihrer angenommenen Richtung dar. Wir haben $k=12, z= 18$, woraus folgt, dass der Spannbaum 11 Kanten hat und es 7 Maschen geben sollte, die links auch schon eingezeichnet wurden.

Zwei Dinge fallen auf. Erstens sind die Knoten 1 und 4 eigentlich überflüssig, da hier ja keine Stromverzeigung stattfindet; sie sind aber auch nicht schädlich, vielmehr benötigen wir sie zur Berechnung der Spannungen, die wir an allen 12 Knoten bestimmen wollen. Zweitens erfüllen die Maschen $M_2$ bis $M_7$ die Einzigkeitsregel (nur eine Verbindungskante pro Masche), aber die Masche $M_1$ erfüllt dies nicht. Ich habe auch keinen Spannbaum gefunden, der mit den zugehörigen Maschen die Einzigkeitsregel erfüllen würde. Trotzdem ist das entstehenden Gleichungssystem eindeutig lösbar.

Wir setzen weiter fest, dass die Maschen alle entgegen dem Uhrzeigersinn durchlaufen werden. Mit diesen Informationen können wir nun das Gleichungssystem zur Berechnung der Maschenströme aufstellen. Die Matrix $R$ ist eine $7 \times 7$ - Matrix, die Vektoren $IM$ und $Uq$ haben dementsprechend 7 Elemente.

$$

R:=

\left(

\begin{array}{ccccccc}

3 & -1 & -1 & -1 & 0 & 0 & 0 \\

-1 & 4 & -1 & 0 & -1 & 0 & 0 \\

-1 & -1 & 4 & -1 & 0 & -1 & 0 \\

-1 & 0 & -1 & 4 & 0 & 0 & -1 \\

0 & -1 & 0 & 0 & 4 & -1 & 0 \\

0 & 0 & -1 & 0 & -1 & 4 & -1 \\

0 & 0 & 0 & -1 & 0 & -1 & 4 \\

\end{array}

\right)

\quad

Uq:=

\left(

\begin{array}{c}

x\\

0\\

0\\

0\\

0\\

0\\

0\\

\end{array}

\right)

$$

Die Lösung dieses Systems habe ich mit einem Computeralgebraprogramm (Maple) berechnet; es ergibt sich:

$$

IM =

\left(

\begin{array}{c}

\frac{161}{267}x \\

\frac{67}{267}x \\

\frac{82}{267}x \\

\frac{67}{267}x \\

\frac{25}{267}x \\

\frac{33}{267}x \\

\frac{25}{267}x \\

\end{array}

\right)

$$

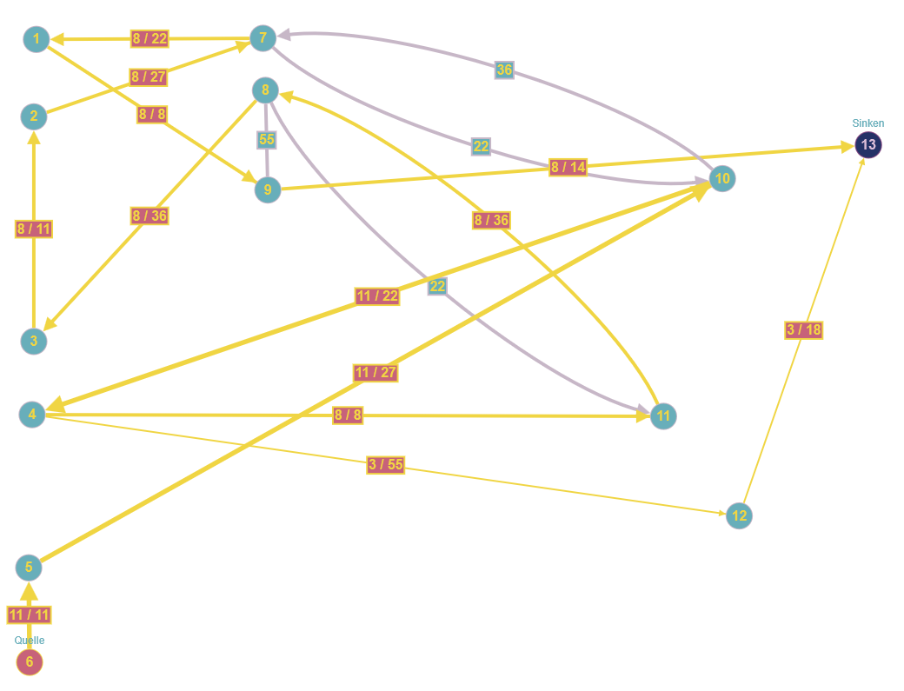

Aus den Maschenströmen folgen nun die Ströme an den Kanten des Gleichstromgraphens, z.B. ist $I_0=\frac{161}{267}x = 0,603x.$ Insgesamt erhält man:

Dabei muss man sich jeden Zahlenwert in obiger Abbildung mit x multipliziert denken. Die schwarzen Werte stellen die Stromstärke in der jeweiligen Kante dar (in $[A]$), dabei habe ich bei den Kanten, die aufgrund des Ergebnisses eine negative Stromstärke hatten, die Richtung geändert. Die roten Zahlen stellen nun die Spannungen (in $[V]$) dar, die an den zugehörigen Knoten gegen Null gemessen werden, also misst man beispielsweise am Knoten 4 eine Spannung von $0.345\cdot x [V]$ gegenüber dem Konten 12 (oder dem Minuspol der Spannungsquelle). Wie berechnet man nun diese Spannungen. Ganz einfach: da zwischen Knoten 12 und 8 bei $1[\Omega]$ Widerstand ein Strom von $0.251\cdot x [A]$ fließt, liegt nach dem Ohmschen Gesetz zwischen 12 und 8 eine Spannung von $0.251\cdot x [V]$ und zwischen 8 und 4 eine Spannung von $0.094\cdot x [V]$ an. Das ergibt zusammenaddiert eine Spannung von $0.345\cdot x [V]$. Auch hier ist die Richtung der Kanten zu berücksichtigen! Will man z.B. die Spannung zwischen 12 und 5 berechnen, so addieren sich die Werte von 12 bis 9 zu 1.0 auf und dann muss man wegen der entgegengerichteten Kante von 9 bis 5 den Wert 0.251 abziehen. (Hätte ich die Kanten bei negativem Strom nicht umgekehrt, wäre es vielleicht noch augenfälliger gewesen.)

Ja, die roten Spannungsfaktoren sind genau die Wahrscheinlichkeiten des Zufallswanderers. Zufall? Nein natürlich nicht. Das ist es ja gerade, worauf Hochfilzer hinaus wollte: Hier wird das gleiche Stück Mathematik auf zwei völlig verschiedene Aufgabenstellungen angewendet und liefert korrespondierende Ergebnisse. Und Hochfilzer setzt noch einen drauf: Die Wege des Zufallswanderers sind Beispiele für Markovketten, einem Teilgebiet der Stochastik.

In einem kleinen Anhang habe ich eine tiefergehende Begründung über dieses "gleiche Stück Mathematik" (über harmonische Funktionen) beschrieben.

Harmonisch.pdf

2 Von v nach w, Wege durch Graphen

Definiton 2.1 (Weg, Pfad, Zyklus, Kreis, Eulerweg-/kreis, Hamiltonweg-/kreis, Kantenfolge) [8]

Sei $G = (V,E)$ Graph (egal ob gerichtet oder nicht, egal ob Mehrfachkanten vorkommen) und $W=(v_1, \cdots, v_n)$ ein n-Tupel von Knoten aus $V$, sodass für alle $i \in \{1, \cdots, n-1\}$ gilt:

- $\{v_i, v_{i+1}\} \in E$, falls $G$ ungerichteter Graph ohne Mehrfachkanten ist

- $(v_i, v_{i+1}) \in E$, falls $G$ gerichteter Graph ohne Mehrfachkanten ist

- $E(\{v_i, v_{i+1}\}) > 0$, falls $G$ ungerichteter Graph mit Mehrfachkanten ist

- $E((v_i, v_{i+1})) > 0$, falls $G$ ungerichteter Graph mit Mehrfachkanten ist.

$v_i$ und $v_{i+1}$ sind also jeweils durch eine Kante verbunden. $W$ nennt man ungerichteten Weg, wenn $G$ ungerichtet ist, gerichteten Weg, wenn $G$ gerichtet ist. $v_1$ heißt Startknoten, $v_n$ Endknoten des Weges. Als Weglänge bezeichnen wir die Anzahl der Kanten des Weges.

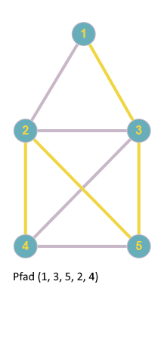

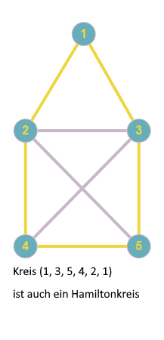

Ein Weg $W$ heißt

- Pfad, wenn die $v_i$ paarweise verschieden sind

- Zyklus, wenn Startknoten und Endknoten gleich sind ($v_1=v_n$)

- Kreis, wenn nur Startknoten und Endknoten von $W$ gleich sind (oder auch: $v_1 = v_n$ und $(v_1, \cdots, v_{n-1})$ einen Pfad bilden)

- Eulerweg, wenn $W$ ein Weg ist, der alle Kanten des Graphen $G$ genau einmal enthält

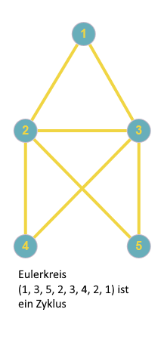

- Eulerkreis, wenn $W$ ein Zyklus ist, der alle Kanten des Graphen $G$ genau einmal enthält (Kein Kreis, Knoten dürfen mehrfach vorkommen!)

- ein zusammenhängender Graph, der einen Eulerkreis besitzt heißt eulerscher Graph

- Hamiltonweg, wenn jeder Knoten des Graphen $G$, genau einmal durchlaufen wird

- Hamiltonkreis, ein Zyklus, bei dem jeder Knoten des Graphen $G$ genau einmal durchlaufen wird.

Bei Wegen, Pfaden, Zyklen und Kreisen ist es egal, welche Kante in einem Multigraphen von Knoten zu Knoten benutzt wird, da die Definition nur Knoten beinhaltet.

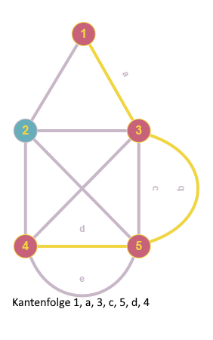

Eine Kantenfolge ist eine Abfolge von Knoten und Kanten, die abwechselnd aufeinander folgen und deren Kanten immer die beiden benachbarten Knoten enthalten. Formaler:

Kantenfolge $= v_1, e_1, v_2, e_2, \cdots, e_{n-1}, v_n$ mit $e_i=\{v_i,v_{i+1}\}$ für alle $i=1..n-1$. Kanten und Knoten können sich innerhalb einer Kantenfolge wiederholen. Ein Kantenzug von $v_1$ bis $v_n$ impliziert die Existenz eines Weges von $v_1$ nach $v_n$.

Bemerkung 2.2

Ein Hamiltonkreis ist ein Hamiltonweg, ein Eulerkreis ist ein Eulerweg, ein Kreis ist ein Zyklus, ein Pfad ist ein Weg.

Für Eulerwege und Eulerkreise gibt es einen wesentlichen Satz, der eulersche Graphen charakterisiert. Er stellt einen Zusammenhang zum Grad der Knoten eines Graphen her.

Satz 2.3 (Euler-Hierholzer) [10]

Sei $G$ ein ungerichteter, zusammenhängender Graph. Dann sind folgende Aussagen äquivalent:

- $G$ ist ein eulerscher Graph

- jeder Knoten in $G$ hat geraden Grad

- die Kantenmenge von $G$ ist die Vereinigungsmenge aller Kanten von paarweise disjunkten Kreisen.

Einen analogen Satz gibt es für gerichtete Graphen. Hierholzer hat auch einen Algorithmus zum Auffinden von Eulerkreisen entwickelt.

Korollar 2.4

Ein ungerichteter, zusammenhängender Graph enthält genau dann einen Eulerweg, wenn zwei oder keiner seiner Konten von ungeradem Grad sind. Gibt es in $G$ keinen Knoten mit ungeradem Grad, ist der Eulerweg sogar ein Eulerkreis.

Im nächsten Kapitel werde ich Beispiele für die Anwendung dieses Satz vorstellen.

Satz 2.5 (Dirac) [11]

Jeder einfache Graph (ungerichtet, ohne Mehrfachknoten, ohne Schleifen) $G$ der Ordnung $n$ mit Minimalgrad $\delta(g) \geq \frac{n}{2}$ hat einen Hamiltonkreis.

Eng verbunden mit Wegen in Graphen ist die Angabe von Kantengewichten, die meistens einen konkreten Anwendungsbezug haben, z.B. als Entfernungen zwischen den Knoten oder als Kosten bei der Nutzung der Kanten. Diese Gewichte können durchaus auch negativ sein. Kantengewichte sind durch die bereits definierte Kantengewichtsfunktion (Def. 1.11) gegeben.

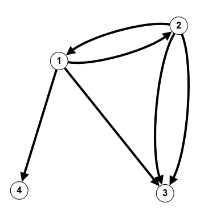

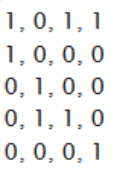

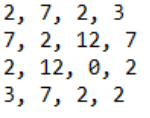

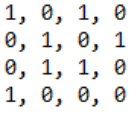

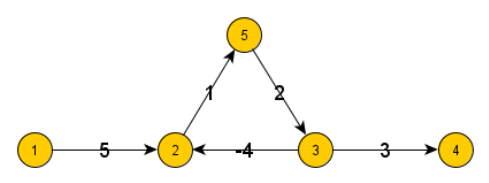

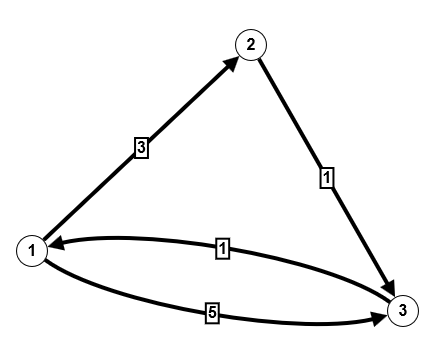

Eine interessante erste Aufgabenstellung zu Wegen in Graphen ist die Frage nach der Anzahl von Wegen von einem Knoten i zu einem anderen Knoten j. Betrachten wir dazu einerseits den folgenden ungerichteten Graphen mit Mehrfachkante [20]:

---^3-->

---^3-->

Wieviele verschiedene Wege der Länge 3 gibt es in diesem Graphen?

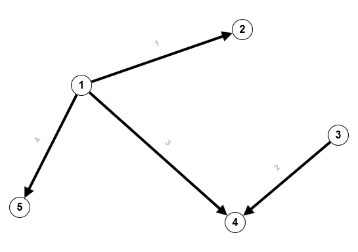

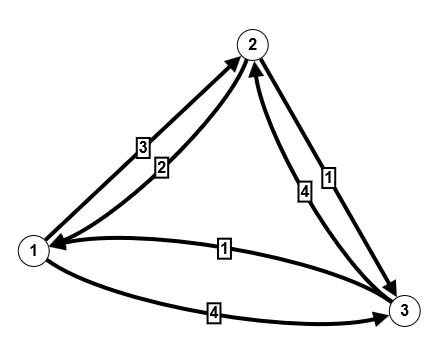

Andererseits kann man auch in einem gerichteten Graphen ohne Mehrfachkanten die Frage stellen:

---^3-->

---^3-->

Wieviele verschiedene Wege der Länge 3 gibt es in diesem Graphen?

Der folgende Satz beantwortet beide Fragen auf die gleiche Weise.

Satz 2.6 (siehe Satz 1.15g)

a) Sei $G$ ein ungerichteter Graph mit Mehrfachkanten und A die zugehörige Adjazenzmatrix. Dann ist $A^n(i,j)$ die Anzahl der Wege in $G$ von i nach j.

b) Sei $G$ ein gerichteter Graph ohne Mehrfachkanten und A die zugehörige Adjanzenzmatrix. Dann ist $A^n(i,j)$ die Anzahl der Wege in $G$ von i nach j.

Die obigen Abbildungen enthalten rechts neben der Adjazenzmatrix auch ihre 3ten Potenzen. Sie beantworten die gestellten Fragen. Man entnimmt beispielsweise, dass es im obigen Graphen keinen Weg der Länge 3 von Knoten 3 nach Knoten 3 gibt, aber 12 von Knoten 3 nach Knoten 2. Dies ist auf den ersten Blick erstaunlich, da ein Weg von 3 nach 2 (oder auch von 2 nach 3) nicht über 4 und 1 gehen kann, denn dann wäre der Weg zu lang (aber sehr wohl über 4 oder 1). Das bedeutet, es muss allein zwischen 2 und 3 12 Möglichkeiten geben, unterschiedlich zu gehen. Dies liegt natürlich daran, dass es zwischen 2 und 3 eine Mehrfachkante gibt und die Kanten ungerichtet sind. Bezeichnen wird die obere Kante zwischen 2 und 3 mit a, die untere mit b, die Kante zwischen 1 und 2 mit c und die zwischen 2 und 4 mit d. Der jeweilige Rückweg erhält ein Minuszeichen. Dann finden wir folgende Wege zwischen 2 und 3:

(a -a a), (b -b b), (a -a b), (b -b a), (a -b b), (b -a a), (a, -b a), (b -a b), (c -c a), (c -c b), (d -d a), (d -d b)

Andererseits reduzieren gerichtete Graphen die Anzahl der Wege deutlich, da ja ein Hin und Zurück auf der gleichen Kante nicht möglich ist (wenn es nicht einen Hin- und Zurück-Pfeil gibt). In unserem unteren Beispiel tritt erst bei der 5ten Potenz der Adjazenzmatrix (also Weglänge 5) eine Weganzahl von 2 auf. Es ist der Weg von 1 nach 2: $1 \rightarrow 4 \rightarrow 2 \rightarrow 3 \rightarrow 1 \rightarrow 2$ und $1 \rightarrow 2 \rightarrow 3 \rightarrow 1 \rightarrow 4 \rightarrow 2$.

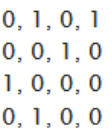

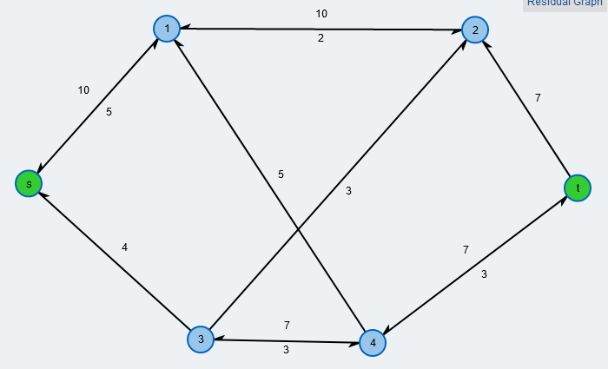

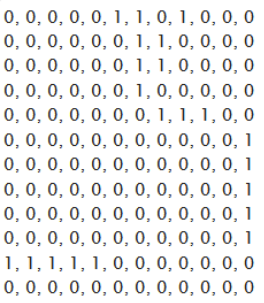

Ich greife hier noch einmal die in Satz 1.15i definierte Erreichbarkeitsmatrix auf. Durch Addition der Potenzen einer Adjazenzmatrix (beginnend bei 0, endend bei n) und Setzen aller positiven Werte auf 1 bekommt man nacheinander die Erreichbarkeit des Knotens j von i aus durch einen Weg der Länge n angezeigt.

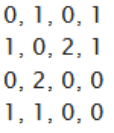

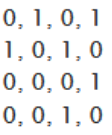

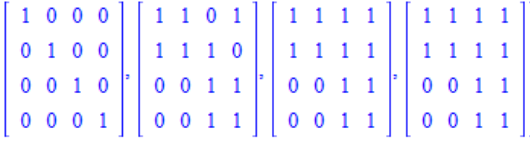

Für den ungerichteten Graphen erhält man die Folge:

für den gerichteten Graphen:

Damit ist in beiden Fällen die komplette Erreichbarkeit gewährleistet, wenn man im ersten Beispiel mindestens Wege bis zur Länge 2 zulässt, im zweiten Fall Wege bis zur Länge 3.

Ein Beispiel, bei dem nicht die Erreichbarkeit aller Knoten untereinander vorhanden ist, kann man dem folgenden Graphen entnehmen; die Folge der Erreichbarkeiten ist in blau dargestellt.

Entsprechend ist der gezeichnete gerichtete Graph nur schwach zusammenhängend.

Auch bei nicht zusammenhängenden Graphen sollte die Erreichbarkeitsmatrix zeigen, welche Knoten nicht miteinander verbunden sind. Das Beispiel hinter Satz 1.18 mit 7 Knoten liefert folgende Erreichbarkeitsfolge:

Die Knoten 3 und 4 sind von den anderen separiert, bilden also eine eigene Zusammenhangskomponente. Somit hat man hier eine andere Methode um zu zeigen, dass ein Graph nicht zusammenhängend ist (neben der Reduzibilität der Adjanzenzmatrix).

Als letztes in diesem Kapitel noch eine Aussage über die Anzahl von Pfaden in einem vollständigen Graphen:

Satz 2.6a

Die Anzahl der verschiedenen Pfade der Länge k zwischen zwei beliebigen Knoten in einem vollständigen Graphen $K_n$ ist $\left(\begin{array} {c} n-2 \\ k-1\\ \end{array}\right)\cdot (k-1)!$

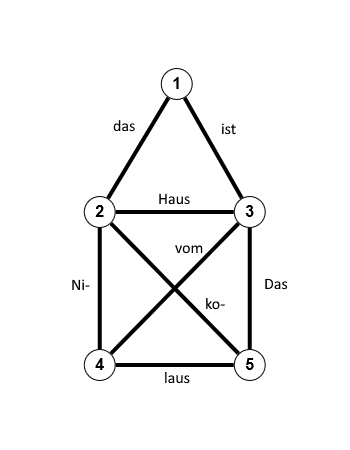

2.1 Der Nikolaus in Königsberg

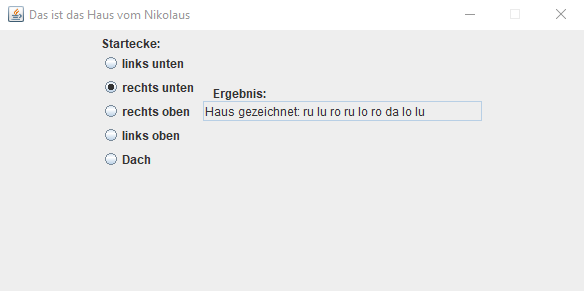

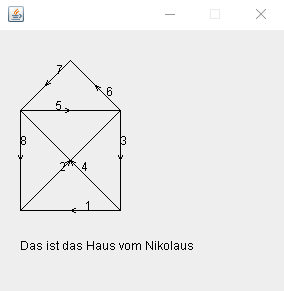

Die gezeigte Lösung ist nicht die einzig mögliche, löst aber die Frage, die mit diesem Haus verbunden ist:

Gibt es einen Eulerweg in diesem Graphen?

Dazu 2 weitere Antworten.

Das Korollar (2.4) zum Satz von Euler-Hierholzer (2.3) gibt eine klare Antwort: Es existiert ein Eulerweg (aber kein Eulerkreis), denn genau 2 Knoten haben einen ungeraden Grad (siehe obige Abbildung).

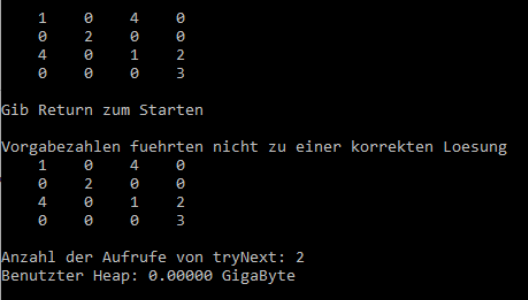

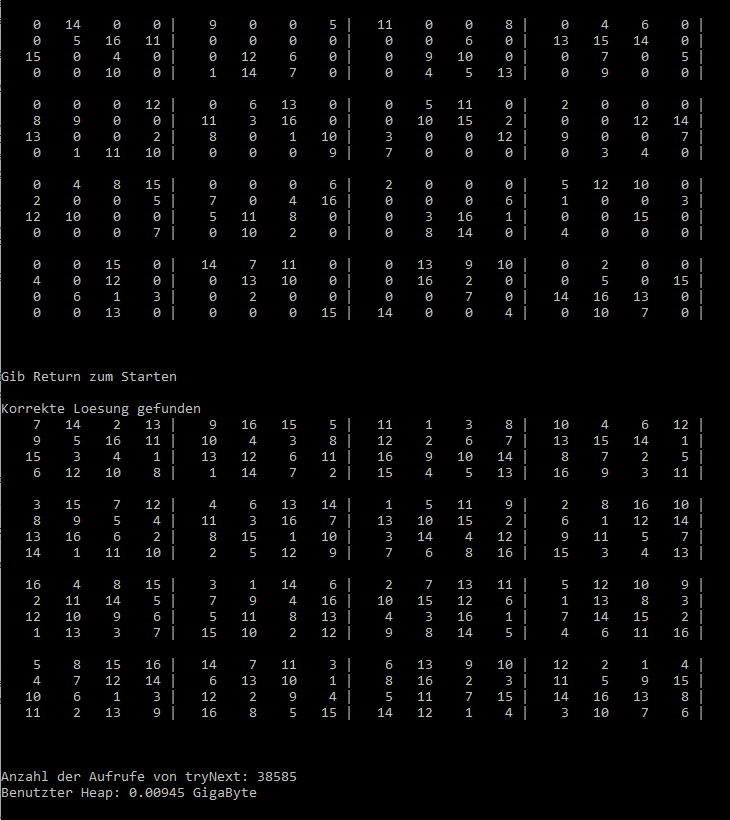

Die zweite Antwort ist mit der Frage verbunden, wie man einen Eulerweg findet. Ich will hier nicht auf allgemeine Algorithmen zur Findung von Eulerwegen oder -kreisen eingehen, sondern nur an diesem Beispiel einen kleinen Algorithmus vorstellen, den ich vor einiger Zeit mal als Übung zu einem rekursiven Java-Programm geschrieben habe. Die Eingabe in das Programm verlangt die Angabe der Ecke, wo der Eulerweg beginnen soll und gibt entweder den Eulerweg aus oder einen Hinweis, dass es keinen gibt.

Wir sehen, dass dieser Weg ebenfalls im Knoten 5 beginnt, aber anders verläuft im ersten Bild, was zeigt, dass ein Eulerweg nicht eindeutig sein muss, selbst wenn er am gleichen Knoten startet.

Diese Ausgabe wird auch bei einem Startknoten "rechts oben" , also 3 und "links oben" also 2 angezeigt. Es fällt auf, dass gerade die Knoten mit geradem Grad keinen Eulerweg zulassen, die ungeraden aber doch. Dies ist leicht zu verstehen, denn wenn man an einem Knoten mit geradem Grad startet und alle Kanten durchlaufen will, dann kommt man nach der letzten Kante dieses Knotens nicht mehr von diesem Knoten weg. WEG - HIN - WEG - HIN für Knoten vom Grade 4. Wenn man hofft, in der Zwischenzeit alle anderen Kanten durchlaufen zu haben, hätte man einen Eulerkreis gefunden, den es aber nicht gibt.

Wen's interessiert, ich habe das kleine Programm mit Programmtext und ausführbarem Code in eine .zip-Datei gepackt; sie kann über den folgenden Link heruntergeladen werden.

Nikolaus.zip

Das nächste Beispiel ist nicht nur klassisch, es ist auch historisch. Die Stadt Königsberg hat 7 Brücken über den Fluß Pregel, die in folgendem Graphen den Kanten entsprechen; die Knoten stellen eine Insel (4) bzw. Ufer des Flusses dar:

Der Mathematiker Leonhard Euler hat sich 1736 der Fragestellung angenommen, ob es einem Weg gibt, bei dem man alle Brücken genau einmal überquert und ob es einen ebensolchen Rundweg gibt, bei dem man wieder am Ausgangspunkt ankommt. Euler hat im Satz 2.3/2.4 die Implikation entdeckt, die aus der Existenz eines Eulerweges in einem Graphen folgt, dass es maximal 2 Knoten ungeraden Grades geben darf (die andere Richtung hat Hierholzer beigesteuert). Damit folgt sofort, dass es keinen Eulerweg und damit auch keinen Eulerkreis geben kann, denn wie man sieht, haben alle 4 Knoten einen ungeraden Grad. Euler war mit dieser Entdeckung einer der Begründer der Graphentheorie.

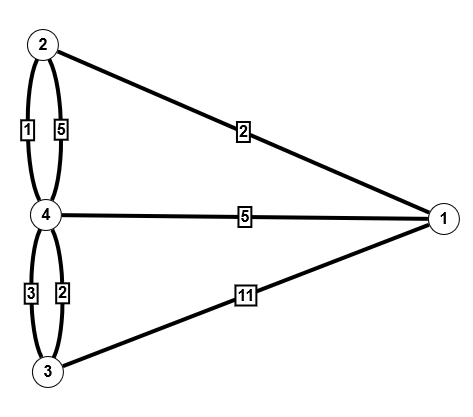

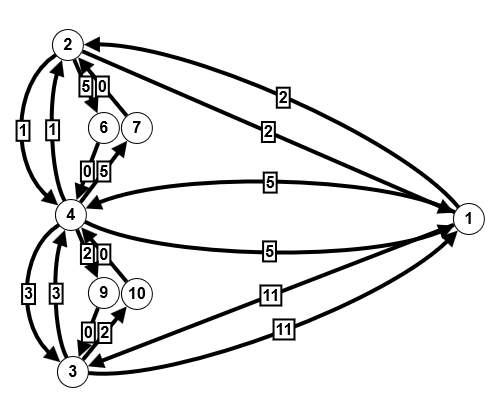

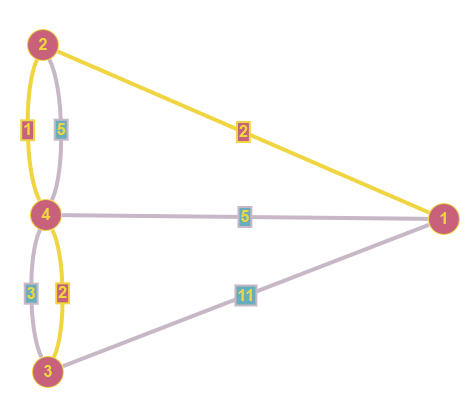

2.2 Kurz und knapp

Obiger Graph auf der linken Seite zeigt, wie viel das Passieren der Brücken kostet. Wir nehmen mal an, wir möchten von 1 nach 3 (also von einer Insel auf das Ufer der Pregel). Der direkte Weg über die Brücke für 11 Kreuzer ist natürlich nicht der günstigste. Anstatt alle Wege durchzuprobieren (was bei der geringen Größe des Graphen möglich wäre), gibt es verschiedene Algorithmen, die solche Probleme lösen. Zu den bekanntesten gehört der Algorithmus von Dijkstra (1959), auf den ich später noch ausführlicher eingehen werde. Aber ich will ihn hier schon einmal anwenden. Der Algorithmus erlaubt keine negativen Gewichte, die in anderen Anwendungen durchaus vorkommen können, ist für gerichtete Graphen gedacht und unterstützt keine Multigraphen. Aber der Brückengraph ist ein ungerichteter Multigraph wegen der doppelten Kanten zwischen 2 und 4 bzw. 3 und 4. Wie bei der Einführung der unterschiedlichen Graphentypen bereits erwähnt, kann man aber ungerichtete Graphen in gerichtete Graphen und einen Multigraphen durch Einfügen zusätzlicher Knoten in einen Graphen ohne Mehrfachkanten überführen. Das Ergebnis sieht man im zweiten Bild, das leider schon nicht mehr allzu übersichtlich ist. Das dritte Bild zeigt das Ergebnis unserer Fragestellung mit Dijkstra berechnet, bei dem ich wegen der besseren Übersichtlichkeit in der Zeichnung wieder auf den ungerichteten Multigraphen zurückgegangen bin. Der kostengünstigste Weg geht also vom Knoten 1 aus und führt über 2 und 4 nach 3, wobei man noch die richtigen Brücken auswählen muss und zahlt dann 5 Kreuzer. Das ist weniger als die Hälfte des direkten Weges, aber man muss auch doppelt so weit laufen.

Nehmen wir jetzt zusätzlich an, dass es Brücken, gibt, die nur in einer Richtung benutzt werden können (Einbahnstraßen), dann erkennt der Dijkstra auch dies richtig und schlägt den optimalen Weg vor.

Links der Weg von 1 nach 3, rechts der Rückweg (billiger wegen der Einbahnstraße).